SM与SP

来源:互联网 发布:蜜蜂软件怎么使用 编辑:程序博客网 时间:2024/04/25 10:03

sp: 最基本的处理单元,streaming processor 最后具体的指令和任务都是在sp上处理的。GPU进行并行计算,也就是很多个sp同时做处理

sm:多个sp加上其他的一些资源组成一个sm, streaming multiprocessor. 其他资源也就是存储资源,共享内存,寄储器等。

warp:GPU执行程序时的调度单位,目前cuda的warp的大小为32,同在一个warp的线程,以不同数据资源执行相同的指令。

thread-->block-->grid:在利用cuda进行编程时,一个grid分为多个block,而一个block分为多个thread。其中任务划分到是否影响最后的执行效果。划分的依据是任务特性和GPU本身的硬件特性。

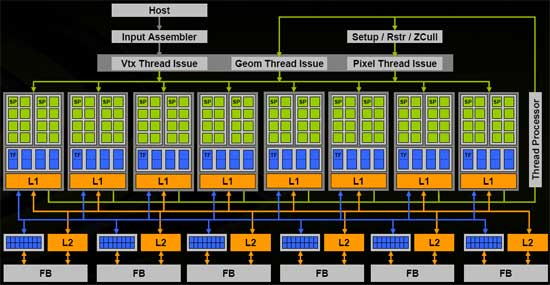

下面几张硬件结构简图 便于理解(图片来源于网上)

以上两图可以清晰地表示出sm与sp的关系。

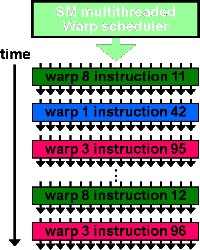

此图反应了warp作为调度单位的作用,每次GPU调度一个warp里的32个线程执行同一条指令,其中各

个线程对应的数据资源不同。

此图是一个warp排程的例子。

一个sm只会执行一个block里的warp,当该block里warp执行完才会执行其他block里的warp。

进行划分时,最好保证每个block里的warp比较合理,那样可以一个sm可以交替执行里面的warp,从而提高

效率,此外,在分配block时,要根据GPU的sm个数,分配出合理的block数,让GPU的sm都利用起来,提

利用率。分配时,也要考虑到同一个线程block的资源问题,不要出现对应的资源不够。

【附】硬件和软件方面的一篇好文章:http://blog.csdn.net/junparadox/article/details/50540602

0 0

- SM与SP

- 流式多处理器(streamingMultiproeessor,SM)与流处理器(strcamingProcessor, sp)

- 流式多处理器(streamingMultiproeessor,SM)与流处理器(strcamingProcessor, sp)

- 解读SM, SP和Warp

- CUDA中grid、block、thread、warp与SM、SP的关系

- [原]CUDA中grid、block、thread、warp与SM、SP的关系

- CUDA中grid、block、thread、warp与SM、SP的关系

- CUDA中grid、block、thread、warp与SM、SP的关系

- CUDA学习----sp, sm, thread, block, grid, warp概念

- CUDA学习笔记08:SM + SP + Grid + Block + Thread 关系

- PIM-DM与SM对比

- 我与SM不得不说的故事(一)

- 黄子韬父亲要求儿子与SM解约

- sm-Spring与Mybatis的整合

- SM,SP和GRID,BLOCK,THREAD之间的对应关系是什么?

- CUDA编程——GPU架构,由sp,sm,thread,block,grid,warp说起

- CUDA流多处理器(stream multiprocessor,sm)和硬件流处理器(stream processor,sp)

- CUDA编程系列--GPU架构,由sp,sm,thread,block,grid,warp说起

- android 应用的颜值,酷炫 UI 组件汇总

- Retrofit2.0使用详解

- 更新cocoapod时出现的ERROR: While executing gem ... (Errno::EPERM) Operation not permitted - /usr/bin/xcod

- 从源代码分析Android-Universal-Image-Loader的缓存处理机制

- 一天一条Linux指令-who

- SM与SP

- 在 Ubuntu 14.04 中安装谷歌 Chrome 浏览器

- scala学习Tips

- 脚本报错:syntax error near unexpected token

- 用POI工具进行导出Excel表格时出现的问题

- JavaScript常用字符串和数组操作归纳

- __attribute__((format(printf,x,y)))

- [YARN] Yarn下Mapreduce的内存参数理解

- Unity3D组件Rigidbody与Collider的概念与区别