SVD奇异值分解详解

来源:互联网 发布:图像分类算法 简单 编辑:程序博客网 时间:2024/06/05 08:09

1. 回顾特征值和特征向量

我们首先回顾下特征值和特征向量的定义如下:

其中A是一个

所对应的特征向量。

求出特征值和特征向量有什么好处呢? 就是我们可以将矩阵A特征分解。如果我们求出了矩阵A的

其中W是这

维矩阵。

一般我们会把W的这

, 也就是说W为酉矩阵。

这样我们的特征分解表达式可以写成

注意到要进行特征分解,矩阵A必须为方阵。那么如果A不是方阵,即行和列不相同时,我们还可以对矩阵进行分解吗?答案是可以,此时我们的SVD登场了。

2. SVD的定义

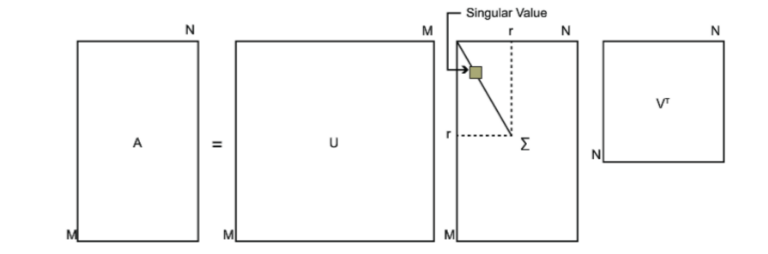

SVD也是对矩阵进行分解,但是和特征分解不同,SVD并不要求要分解的矩阵为方阵。假设我们的矩阵A是一个

其中U是一个

。下图可以很形象的看出上面SVD的定义:

那么我们如何求出SVD分解后的

这三个矩阵呢?

如果我们将A的转置和A做矩阵乘法,那么会得到

这样我们就可以得到矩阵

的矩阵V,就是我们SVD公式里面的V矩阵了。一般我们将V中的每个特征向量叫做A的右奇异向量。

如果我们将A和A的转置做矩阵乘法,那么会得到

这样我们就可以得到矩阵

的矩阵U,就是我们SVD公式里面的U矩阵了。一般我们将U中的每个特征向量叫做A的左奇异向量。

U和V我们都求出来了,现在就剩下奇异值矩阵

就可以了。

我们注意到:

这样我们可以求出我们的每个奇异值,进而求出奇异值矩阵

。

上面还有一个问题没有讲,就是我们说

上式证明使用了:

的特征向量组成的就是我们SVD中的U矩阵。

进一步我们还可以看出我们的特征值矩阵等于奇异值矩阵的平方,也就是说特征值和奇异值满足如下关系:

这样也就是说,我们可以不用

的特征值取平方根来求奇异值。

3. SVD计算举例

这里我们用一个简单的例子来说明矩阵是如何进行奇异值分解的。我们的矩阵A定义为:

我们首先求出

进而求出

接着求

的特征值和特征向量:

利用

求奇异值:

当然,我们也可以用

和1.

最终得到A的奇异值分解为:

4. SVD的一些性质

上面几节我们对SVD的定义和计算做了详细的描述,似乎看不出我们费这么大的力气做SVD有什么好处。那么SVD有什么重要的性质值得我们注意呢?

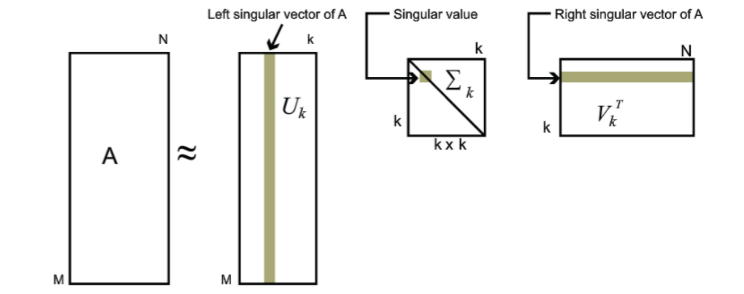

对于奇异值,它跟我们特征分解中的特征值类似,在奇异值矩阵中也是按照从大到小排列,而且奇异值的减少特别的快,在很多情况下,前10%甚至1%的奇异值的和就占了全部的奇异值之和的99%以上的比例。也就是说,我们也可以用最大的k个的奇异值和对应的左右奇异向量来近似描述矩阵。也就是说:

其中k要比n小很多,也就是一个大的矩阵A可以用三个小的矩阵

来表示。如下图所示,现在我们的矩阵A只需要灰色的部分的三个小矩阵就可以近似描述了。

由于这个重要的性质,SVD可以用于PCA降维,来做数据压缩和去噪。也可以用于推荐算法,将用户和喜好对应的矩阵做特征分解,进而得到隐含的用户需求来做推荐。同时也可以用于NLP中的算法,比如潜在语义索引(LSI)。下面我们就对SVD用于PCA降维做一个介绍。

5. SVD用于PCA

在主成分分析(PCA)原理总结中,我们讲到要用PCA降维,需要找到样本协方差矩阵

,当样本数多样本特征数也多的时候,这个计算量是很大的。

注意到我们的SVD也可以得到协方差矩阵

。也就是说,我们的PCA算法可以不用做特征分解,而是做SVD来完成。这个方法在样本量很大的时候很有效。实际上,scikit-learn的PCA算法的背后真正的实现就是用的SVD,而不是我们我们认为的暴力特征分解。

另一方面,注意到PCA仅仅使用了我们SVD的右奇异矩阵,没有使用左奇异矩阵,那么左奇异矩阵有什么用呢?

假设我们的样本是

可以得到一个

- SVD奇异值分解详解

- 奇异值分解(SVD)详解

- 奇异值分解(SVD)详解

- 奇异值分解(SVD)详解

- 奇异值分解(SVD)详解

- 奇异值分解(SVD)详解

- 奇异值分解(SVD)详解

- 奇异值分解(SVD)详解 .

- 奇异值分解(SVD)详解

- 奇异值分解(SVD)详解

- SVD奇异值分解(2)-详解

- 奇异值分解(SVD)详解

- 奇异值分解(SVD)详解

- 奇异值分解(SVD)详解及其应用

- 奇异值分解(SVD)原理详解

- 奇异值分解(SVD)详解及其应用

- SVD奇异值分解

- SVD奇异值分解

- TCP总结笔记

- SAPUI5实现标准应用View替换的开发实践

- 2.Flume安装配置

- Java反射机制

- 移动端确定取消弹窗

- SVD奇异值分解详解

- Javascript(三)

- 最小生成树(Minimum Spanning Tree)

- java\oracle日期格式操作

- 为jEasyUi的日期控件添加一个“清空”按钮----通过修改1.4的easyui.min.js

- 04 Support Vector Machines

- 百度地图

- 答案已在心中

- 变量、常量