1.5 网页下载器与urllib2模块(核心)

来源:互联网 发布:网络炒作公司价格 编辑:程序博客网 时间:2024/06/05 17:29

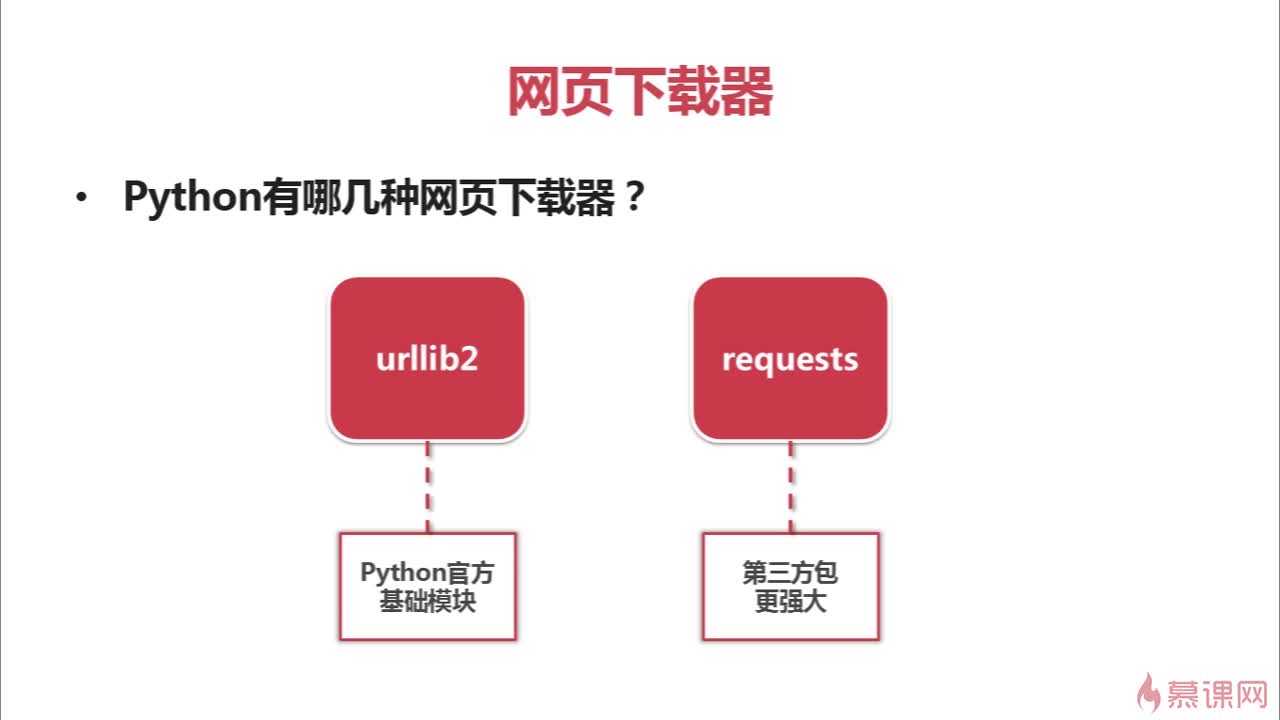

网页下载器

网页下载器:将URL对应的网页以HTML下载到本地,用于后续分析

常见网页下载器:

1. Python官方基础模块:urllib2

2. 第三方功能包:requests

urllib2模块

urllib2下载网页的方法

3种方法,一种比一种强大,后一种是在前一种的扩展:

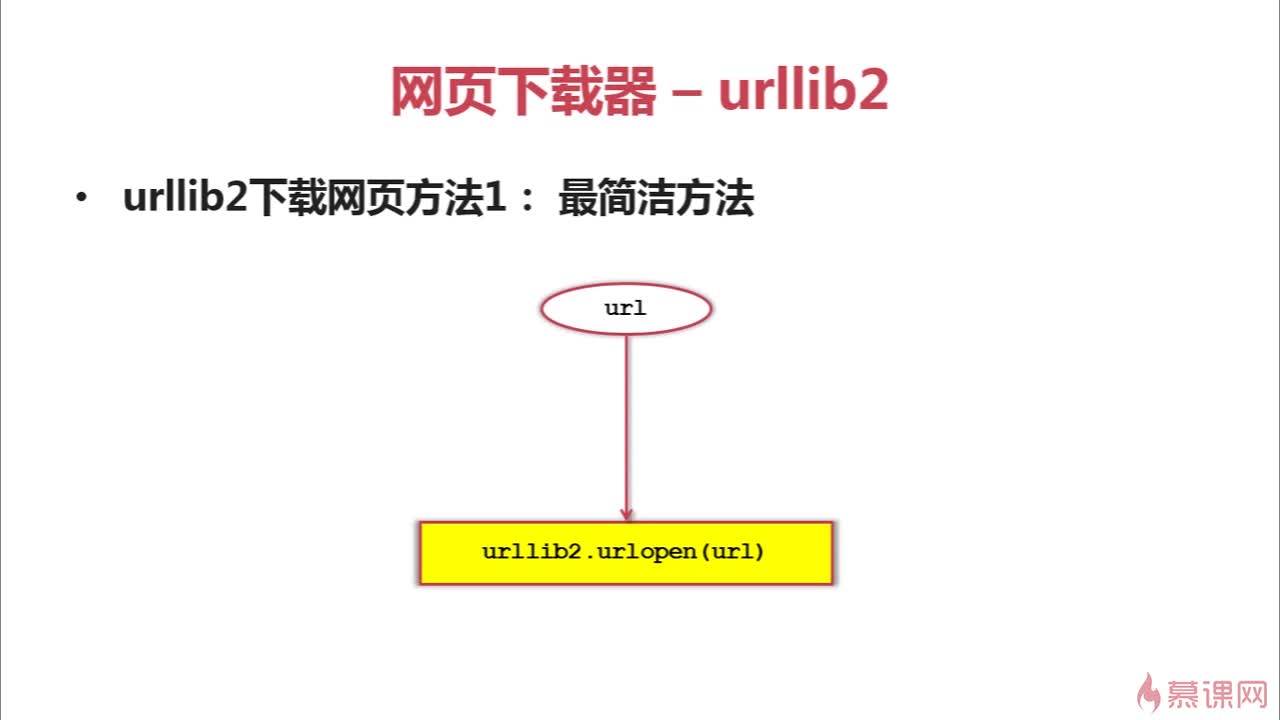

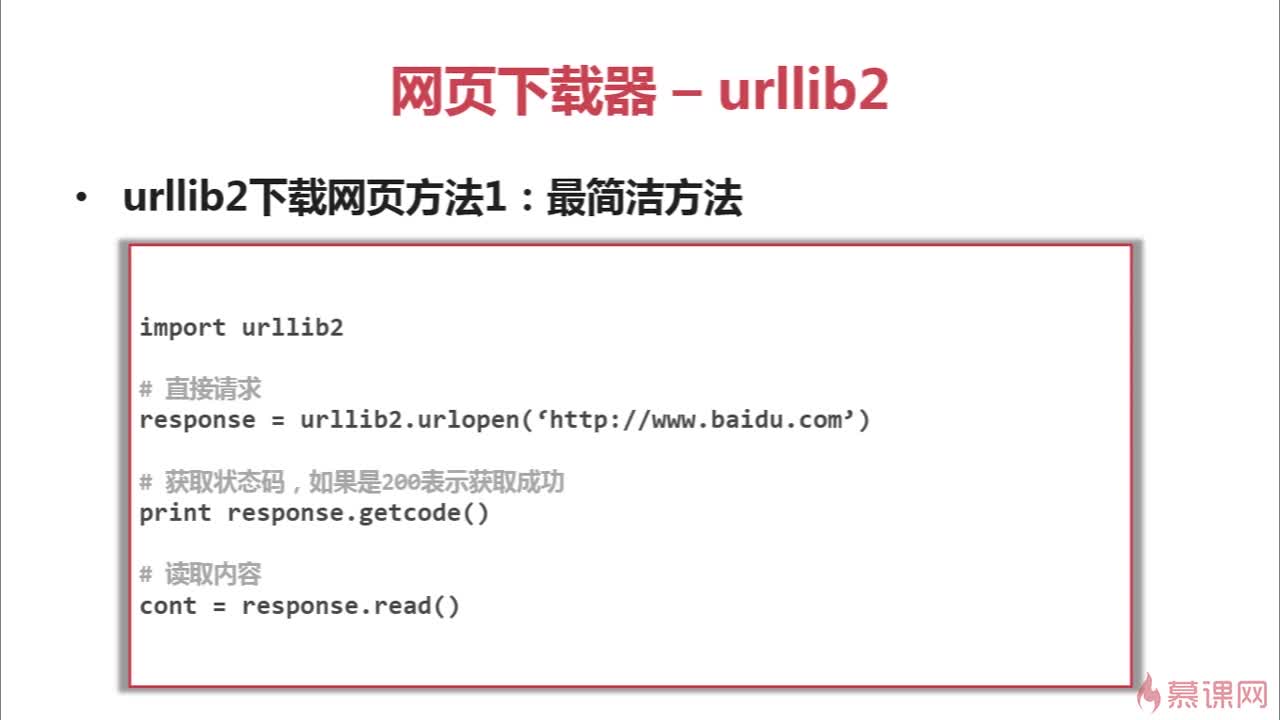

1. 基本方法:直接URL

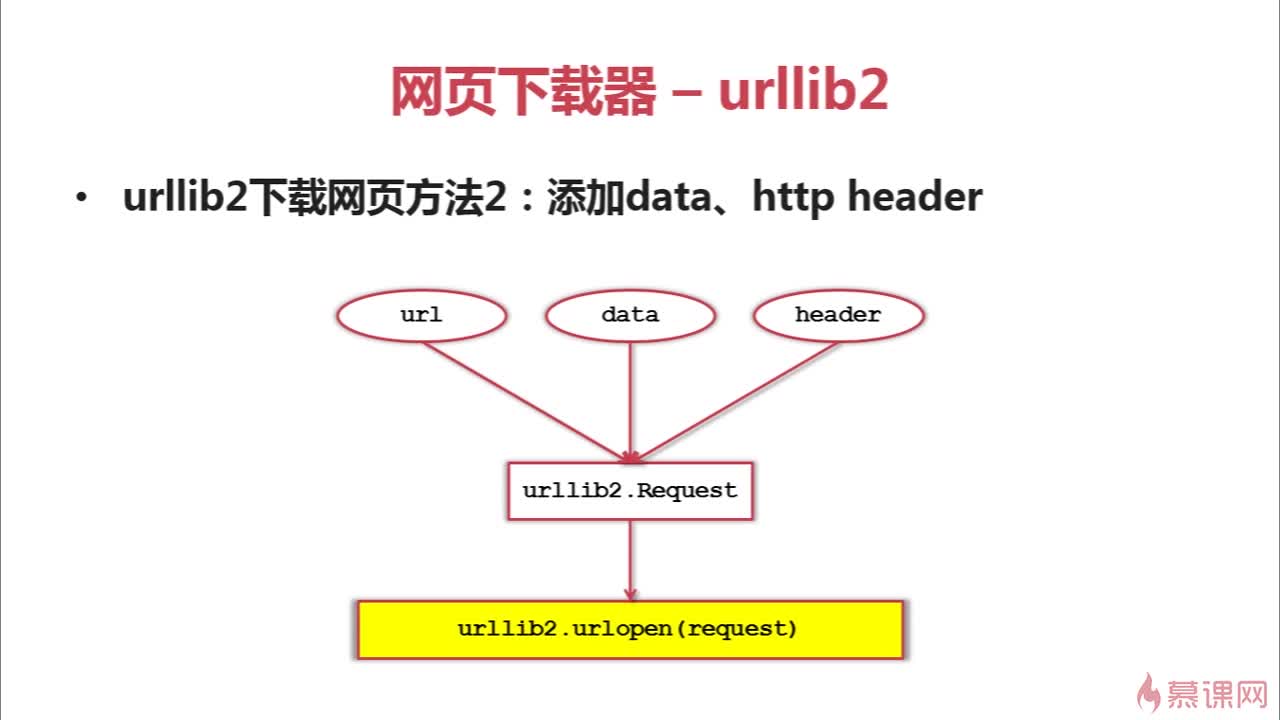

2. 添加data、http header

3. 添加特殊情景

3种方法的详细介绍

1. 基本方法:直接URL

示意图:

代码:

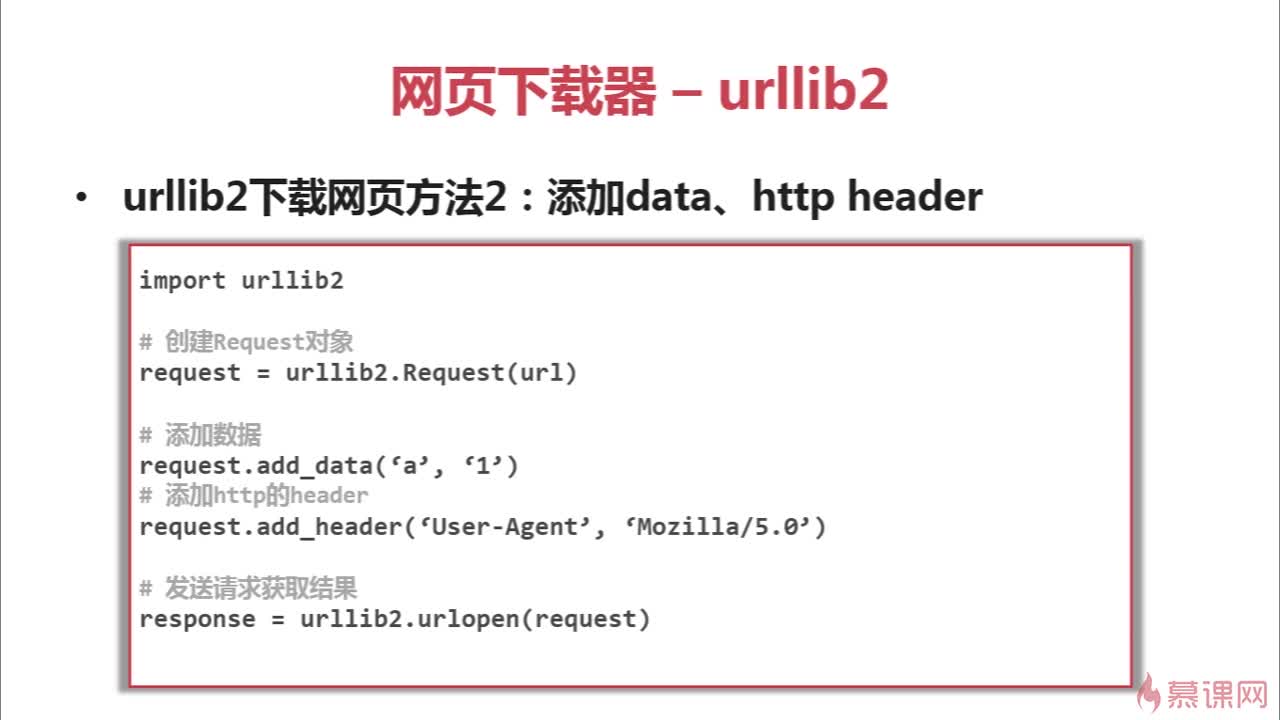

2. 添加data、http header

示意图:

代码:

1. 数据项a的值为1 :可以写用户名密码啥的。

2. 伪装爬虫为Mozilla浏览器。

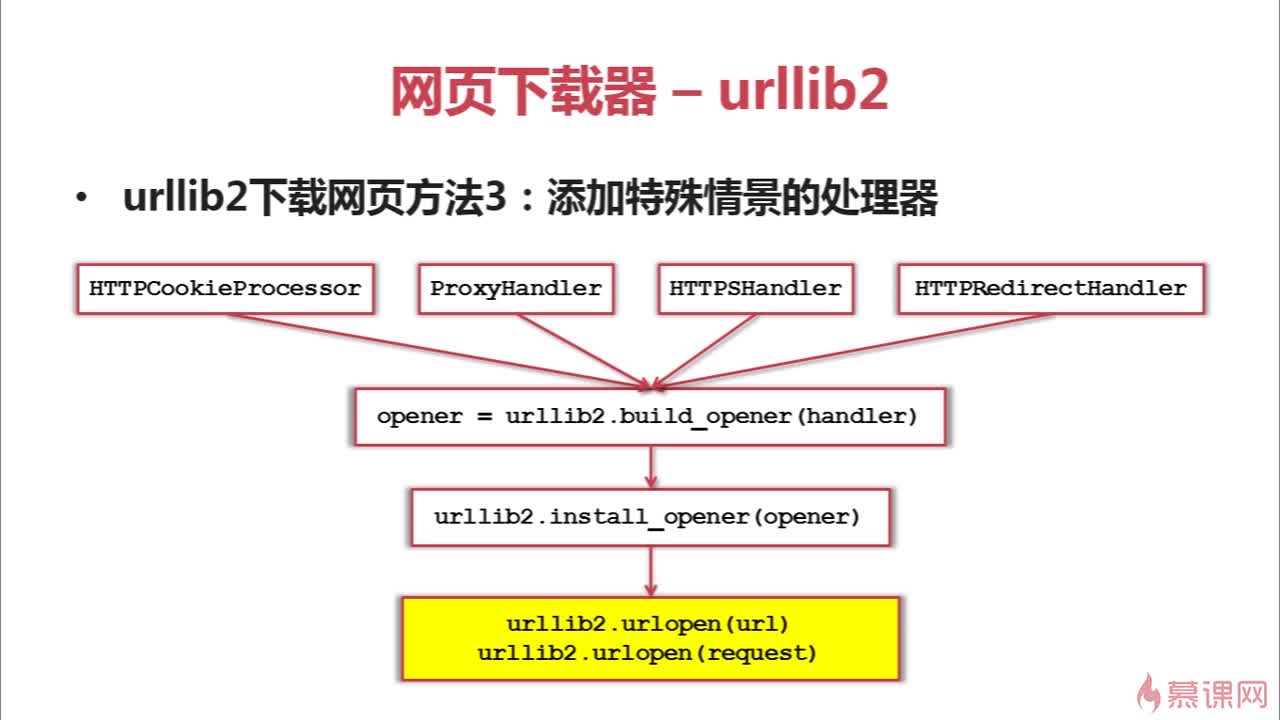

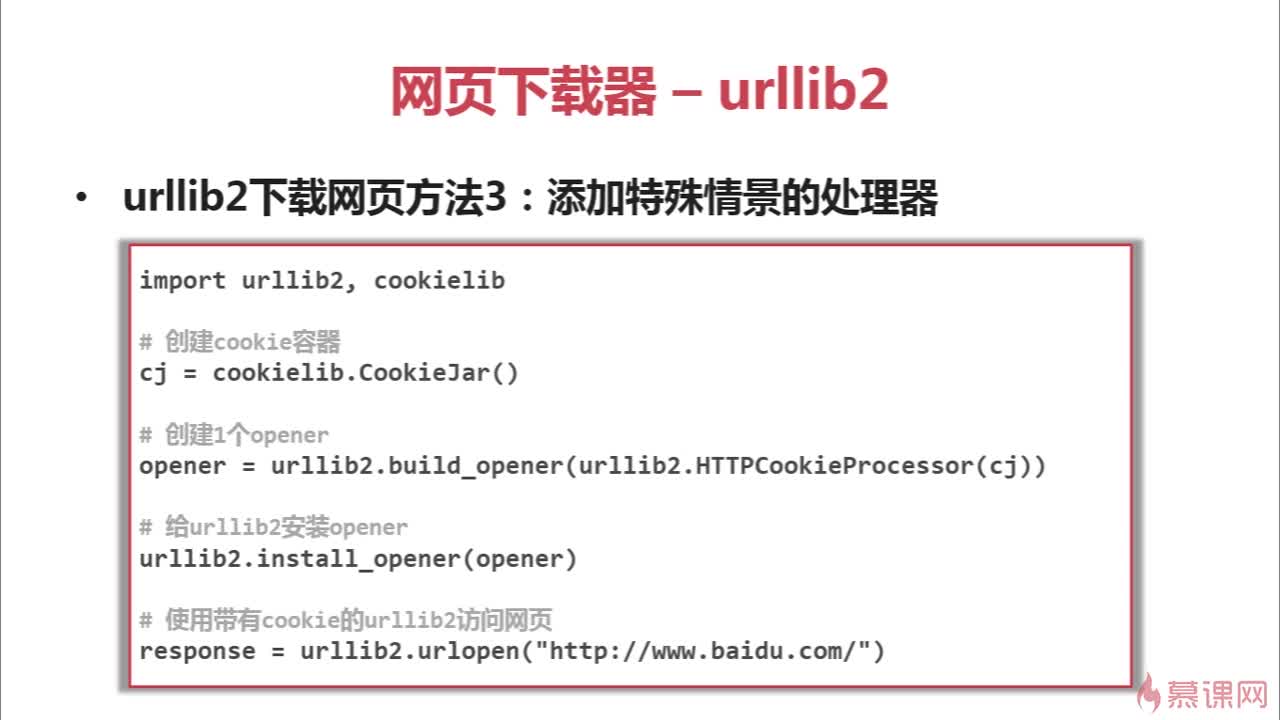

3. 添加特殊情景

示意图:

代码:

- HTTPCookie用户登录情景

- Proxy代理信息

- HTTPS加密信息

- Readirect防止URL互相跳转

urllib2下载的实例

import urllib.requestimport http.cookiejarurl = "http://www.baidu.com"print('第一种方法:')response1 = urllib.request.urlopen(url)print(response1.getcode()) # 200print(len(response1.read()))print('第二种方法')request = urllib.request.Request(url)request.add_header("user-agent", "Mozilla/5.0")response2 = urllib.request.urlopen(request)print(response2.getcode()) # 200print(len(response2.read()))print('第三种方法')cj = http.cookiejar.CookieJar()opener = urllib.request.build_opener(urllib.request.HTTPCookieProcessor(cj))urllib.request.install_opener(opener)response3 =urllib.request.urlopen(url)print(response3.getcode())print(cj)print(response3.read())上面的教程是PYthon2的有些方法已经不能使用。

下面是Python3的使用方法:

1.基本方法

urllib.request.urlopen(url, data=None, [timeout, ]*, cafile=None, capath=None, cadefault=False, context=None)- url: 需要打开的网址

- data:Post提交的数据

- timeout:设置网站的访问超时时间

直接用urllib.request模块的urlopen()获取页面,page的数据格式为bytes类型,需要decode()解码,转换成str类型。

from urllib import requestresponse = request.urlopen(r'http://python.org/') # <http.client.HTTPResponse object at 0x00000000048BC908> HTTPResponse类型page = response.read()page = page.decode('utf-8')urlopen返回对象提供方法:

- read() , readline() ,readlines() , fileno() , close() :对HTTPResponse类型数据进行操作

- info():返回HTTPMessage对象,表示远程服务器返回的头信息

- getcode():返回Http状态码。如果是http请求,200请求成功完成;404网址未找到

- geturl():返回请求的url

2.使用Request

urllib.request.Request(url, data=None, headers={}, method=None)使用request()来包装请求,再通过urlopen()获取页面。

url = r'http://www.lagou.com/zhaopin/Python/?labelWords=label'headers = { 'User-Agent': r'Mozilla/5.0 (Windows NT 6.1; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) ' r'Chrome/45.0.2454.85 Safari/537.36 115Browser/6.0.3', 'Referer': r'http://www.lagou.com/zhaopin/Python/?labelWords=label', 'Connection': 'keep-alive'}req = request.Request(url, headers=headers)page = request.urlopen(req).read()page = page.decode('utf-8')用来包装头部的数据:

- User-Agent :这个头部可以携带如下几条信息:浏览器名和版本号、操作系统名和版本号、默认语言

- Referer:可以用来防止盗链,有一些网站图片显示来源http://*.com,就是检查Referer来鉴定的

- Connection:表示连接状态,记录Session的状态。

3.Post数据

urllib.request.urlopen(url, data=None, [timeout, ]*, cafile=None, capath=None, cadefault=False, context=None)urlopen()的data参数默认为None,当data参数不为空的时候,urlopen()提交方式为Post。

from urllib import request, parseurl = r'http://www.lagou.com/jobs/positionAjax.json?'headers = { 'User-Agent': r'Mozilla/5.0 (Windows NT 6.1; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) ' r'Chrome/45.0.2454.85 Safari/537.36 115Browser/6.0.3', 'Referer': r'http://www.lagou.com/zhaopin/Python/?labelWords=label', 'Connection': 'keep-alive'}data = { 'first': 'true', 'pn': 1, 'kd': 'Python'}data = parse.urlencode(data).encode('utf-8')req = request.Request(url, headers=headers, data=data)page = request.urlopen(req).read()page = page.decode('utf-8')urllib.parse.urlencode(query, doseq=False, safe='', encoding=None, errors=None)urlencode()主要作用就是将url附上要提交的数据。

data = { 'first': 'true', 'pn': 1, 'kd': 'Python'}data = parse.urlencode(data).encode('utf-8')经过urlencode()转换后的data数据为?first=true?pn=1?kd=Python,最后提交的url为

http://www.lagou.com/jobs/positionAjax.json?first=true?pn=1?kd=PythonPost的数据必须是bytes或者iterable of bytes,不能是str,因此需要进行encode()编码

page = request.urlopen(req, data=data).read()当然,也可以把data的数据封装在urlopen()参数中

4.异常处理

def get_page(url): headers = { 'User-Agent': r'Mozilla/5.0 (Windows NT 6.1; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) ' r'Chrome/45.0.2454.85 Safari/537.36 115Browser/6.0.3', 'Referer': r'http://www.lagou.com/zhaopin/Python/?labelWords=label', 'Connection': 'keep-alive' } data = { 'first': 'true', 'pn': 1, 'kd': 'Python' } data = parse.urlencode(data).encode('utf-8') req = request.Request(url, headers=headers) try: page = request.urlopen(req, data=data).read() page = page.decode('utf-8') except error.HTTPError as e: print(e.code()) print(e.read().decode('utf-8')) return page5、使用代理

urllib.request.ProxyHandler(proxies=None)当需要抓取的网站设置了访问限制,这时就需要用到代理来抓取数据。

data = { 'first': 'true', 'pn': 1, 'kd': 'Python' }proxy = request.ProxyHandler({'http': '5.22.195.215:80'}) # 设置proxyopener = request.build_opener(proxy) # 挂载openerrequest.install_opener(opener) # 安装openerdata = parse.urlencode(data).encode('utf-8')page = opener.open(url, data).read()page = page.decode('utf-8')return page- 1.5 网页下载器与urllib2模块(核心)

- 第五章 网页下载器和urllib2模块

- 网页下载器urllib2简介

- Python爬虫----网页下载器和urllib2模块及对应的实例

- Python的网页下载器:urllib2.urlopen

- 【Python】Python的urllib模块、urllib2模块进行网页下载文件

- 【Python】Python的urllib模块、urllib2模块进行网页下载文件

- urllib2下载器网页的三种方法

- python网页请求urllib2模块简单封装

- Python 使用urllib2模块实现断点续传下载

- Python urllib2模块post/get 下载网络资源

- python开发爬虫----urllib2下载网页方法

- 通过urllib2与re模块获取matplotlib实例源码批量下载脚本

- urllib2模块

- urllib2模块

- urllib2模块

- urllib2模块

- Python实战(二)—— urllib2 下载网页的方式总结

- Excel-乘法表

- WebView下载文件

- Qt5.8 + VS2015 环境搭建

- Spring-cloud Eureka 集群

- 隐藏自己的小秘密

- 1.5 网页下载器与urllib2模块(核心)

- 广播监听系统切换语言变换

- 去除UITabBar底部的一条线

- LTspice introduction

- 转载:stm32 数据类型的定义(常用的U8,U16,U32到底代表什么)

- 2017实习生面试经历

- 多种数据库添加自增主键

- stdafx.h的作用

- Evaluate Division