机器学习(1)--logistic回归和softmax回归

来源:互联网 发布:监控员工上网的软件 编辑:程序博客网 时间:2024/05/17 23:17

logistic回归和softmax回归放在一起总结一下,其实softmax就是logistic的推广,logistic一般用于二分类,而softmax是多分类。

logistic回归虽然也是叫回归,其实本身是用来分类的,logistic可以被看成是一种概率的估计,类似于线性回归的归一化,将输出值映射为(0,1),输入值大于0.5被分为1类,小于0.5被分为0类。

softmax回归与多个二分类的区别

如果你在开发一个音乐分类的应用,需要对k种类型的音乐进行识别,那么是选择使用 softmax 分类器呢,还是使用 logistic 回归算法建立 k 个独立的二元分类器呢?

这一选择取决于你的类别之间是否互斥,例如,如果你有四个类别的音乐,分别为:古典音乐、乡村音乐、摇滚乐和爵士乐,那么你可以假设每个训练样本只会被打上一个标签(即:一首歌只能属于这四种音乐类型的其中一种),此时你应该使用类别数 k = 4 的softmax回归。(如果在你的数据集中,有的歌曲不属于以上四类的其中任何一类,那么你可以添加一个“其他类”,并将类别数 k 设为5。)

如果你的四个类别如下:人声音乐、舞曲、影视原声、流行歌曲,那么这些类别之间并不是互斥的。例如:一首歌曲可以来源于影视原声,同时也包含人声 。这种情况下,使用4个二分类的 logistic 回归分类器更为合适。这样,对于每个新的音乐作品 ,我们的算法可以分别判断它是否属于各个类别。

现在我们来看一个计算视觉领域的例子,你的任务是将图像分到三个不同类别中。(i) 假设这三个类别分别是:室内场景、户外城区场景、户外荒野场景。你会使用sofmax回归还是 3个logistic 回归分类器呢? (ii) 现在假设这三个类别分别是室内场景、黑白图片、包含人物的图片,你又会选择 softmax 回归还是多个 logistic 回归分类器呢?

在第一个例子中,三个类别是互斥的,因此更适于选择softmax回归分类器。而在第二个例子中,建立三个独立的 logistic回归分类器更加合适。

写博客一方面是自己总结知识,另一方面也是写出来方便以后自己复习,所以不拘泥于博客的版面,尤其是这种公式如此之多的编辑,我就自己写在本子上,上传咯。

softmax: 用于多个类别的情况

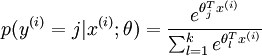

在Softmax回归中将  分类为类别

分类为类别  的概率为:

的概率为:

.

.

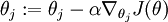

对于  的最小化问题,我们使用迭代的优化算法(例如梯度下降法,或 L-BFGS)。经过求导,我们得到梯度公式如下:

的最小化问题,我们使用迭代的优化算法(例如梯度下降法,或 L-BFGS)。经过求导,我们得到梯度公式如下:

![\begin{align}\nabla_{\theta_j} J(\theta) = - \frac{1}{m} \sum_{i=1}^{m}{ \left[ x^{(i)} \left( 1\{ y^{(i)} = j\} - p(y^{(i)} = j | x^{(i)}; \theta) \right) \right] }\end{align}](http://ufldl.stanford.edu/wiki/images/math/5/9/e/59ef406cef112eb75e54808b560587c9.png)

- 将它代入到梯度下降法等算法中,来最小化

。 例如,在梯度下降法的标准实现中,每一次迭代需要进行如下更新:

。 例如,在梯度下降法的标准实现中,每一次迭代需要进行如下更新:  (

( )。

)。

有一点需要注意的是,按上述方法用softmax求得的参数并不是唯一的,因为,对每一个参数来说,若都减去一个相同的值,依然是上述的代价函数的值。证明如下:

这表明了softmax回归中的参数是“冗余”的。更正式一点来说,我们的softmax模型被过度参数化了,这意味着对于任何我们用来与数据相拟合的估计值,都会存在多组参数集,它们能够生成完全相同的估值函数hθ将输入x映射到预测值。因此使J(θ)最小化的解不是唯一的。而Hessian矩阵是奇异的/不可逆的,这会直接导致Softmax的牛顿法实现版本出现数值计算的问题。

为了解决这个问题,加入一个权重衰减项到代价函数中:

有了这个权重衰减项以后(对于任意的λ>0),代价函数就变成了严格的凸函数而且hession矩阵就不会不可逆了。

此时的偏导数:

...............................................................................................................................................................................\

贴图:简要叙述logistic与softmax关系,其实上面已经写了代价函数的类似表达。还有,就是呈现softmax的由来。。。

.........................................................................................................logistic与softmax的推导涉及到知识是指数分布族

ok,原理公式差不多就这些

- 机器学习--logistic回归和softmax回归

- 机器学习(1)--logistic回归和softmax回归

- logistic回归和softmax回归

- 机器学习->监督学习->logistic回归,softMax回归

- 机器学习----Softmax回归

- 机器学习:Softmax回归

- logistic回归和softmax回归几个文章

- 机器学习算法之一-logistic回归、softmax模型

- 机器学习-Logistic回归

- 机器学习-logistic回归

- 【机器学习】Logistic回归

- 机器学习-Logistic回归

- 机器学习-Logistic回归

- 机器学习--logistic回归

- Logistic and Softmax Regression (逻辑回归和Softmax回归)

- Logistic and Softmax Regression (逻辑回归和Softmax回归)

- Softmax回归与Logistic回归

- Logistic回归与Softmax回归

- HTML5 Web SQL 对数据库的操作

- 001. Spring HelloWorld

- Android系统机制

- Window7搭建Telnet服务器

- PyQt-3

- 机器学习(1)--logistic回归和softmax回归

- css

- iOS 项目的目录结构能看出你的开发经验

- java实现多继承

- 简析TCP协议--三次握手和四次挥手

- Android性能优化

- Android四大组件之Activity

- MySQL 5.7多源复制实践

- 状态码