《Attention-based LSTM for Aspect-level Sentiment Classification》阅读笔记

来源:互联网 发布:动态矩阵控制 编辑:程序博客网 时间:2024/06/04 18:42

《Attention-based LSTM for Aspect-level Sentiment Classification》阅读笔记

转载请注明出处:西土城的搬砖日常

原文链接:Attention-based LSTM for Aspect-level Sentiment Classification

来源:EMNLP2016

问题:aspect level 情感分析

一、aspect level情感分析

给定句子和相应aspect,aspect level的任务是判断所给句子在指定aspect上的情感倾向。

aspect level情感分析的关键问题在于捕捉不同的context word对于特定aspect的重要性,利用这个信息做句子的语义表示。关于aspect level情感分析更具体的介绍可以参考《Aspect Level Sentiment Classification with Deep Memory Network》学习笔记。

二、本文主要工作

本文主要是通过attention机制来捕获不同上下文信息对给定aspect的重要性,将attention机制与LSTM结合起来对句子进行语义建模,解决aspect level情感分析的问题。

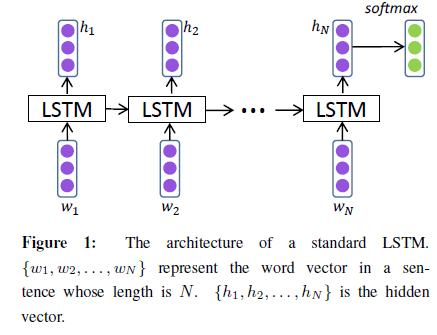

1、standard LSTM

标准LSTM的模型结构如下图所示,

模型说明:

- 每一时刻输入word embedding,细胞状态和隐层状态按下述公式更新,

- 最后一个隐层状态的输出作为句子的语义表示;

- softmax分类;

- 交叉熵做损失函数。

存在的问题:

这种标准LSTM模型没有考虑特定aspect和上下文之间的关联影响,无法区分出对特定aspect更重要的上下文信息。

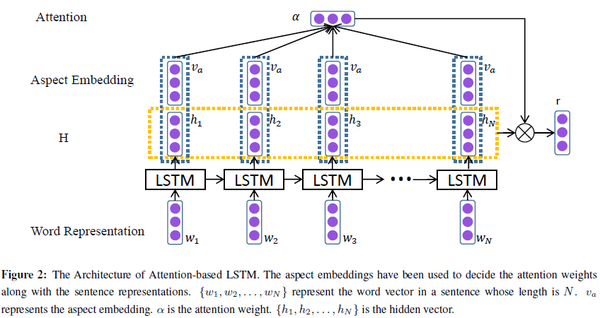

2、Attention-based LSTM(AT-LSTM)

AT-LSTM的模型结构如下图所示,

模型说明:

每一时刻输入word embedding,LSTM的状态更新,将隐层状态和aspect embedding结合起来,aspect embedding作为模型参数一起训练,得到句子在给定aspect下的权重表示r。具体计算公式如下,

最终的句子表示为,

得到句子的语义表示之后,利用softmax分类,

3、Attention-based LSTM with Aspect Embedding (ATAE-LSTM)

AT-LSTM在计算attention权重的过程中引入了aspect的信息,为了更充分的利用aspect的信息,作者在AT-LSTM模型的基础上又提出了ATAE-LSTM模型,在输入端将aspect embedding和word embedding结合起来。

ATAE-LSTM模型结构如下图所示,

模型说明:

在AT-LSTM的基础上,将aspect embedding和word embedding结合起来作为输入,aspect embedding依然是作为模型参数一起训练。

三、实验

1、数据实验所用数据是SemEval 2014 Task4的用户评论数据集,具体分布情况如下表所示。

数据集中的每一条评论对应一个aspect列表和相应aspect情感倾向的列表。

例: The restaurant was too expensive. aspect:{price} polarity:{negative}

2、实验结果

TD-LSTM和TD-LSTM是Effective LSTMs for Target-Dependent Sentiment Classification这篇文章中提出的两个模型,具体介绍可以参考《Effective LSTMs for Target-Dependent Sentiment Classification》学习笔记。

实验结果可以看出,在实验数据集上,ATAE-LSTM取得了最好结果。

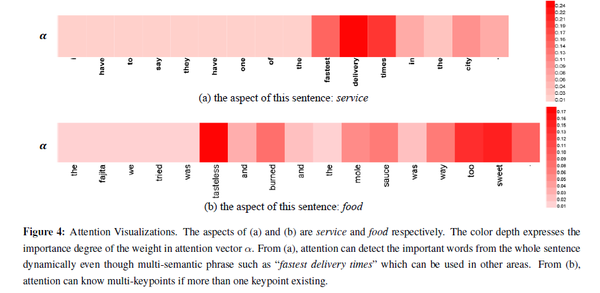

3、Attention Visualization

图(b)中,输入句子为 “The fajita we tried was tasteless and burned and the mole sauce was way too sweet.”,aspect为"food",tasteless和too sweet权重较高。

四、总结

1、本文将attention与LSTM结合在一起,通过attention去获取对不同aspect更重要的上下文信息,来解决aspect level情感分析问题,在实验数据集上取得了较好效果。

2、目前的模型中,不同的aspect只能独立输入处理,怎样才能通过attention一次处理多个aspect是一个值得深入探讨的方向。

最后面给出来我现在初步开始学习LSTM的一些资料链接:

什么是 LSTM RNN

https://zhuanlan.zhihu.com/p/24813287理解长短期记忆(LSTM) 神经网络

https://zhuanlan.zhihu.com/p/24018768

- 《Attention-based LSTM for Aspect-level Sentiment Classification》阅读笔记

- Aspect-level Sentiment Classification using attention mechanism

- Aspect Level Sentiment Classification with Deep Memory Network笔记

- 论文《Aspect Level Sentiment Classification with Deep Memory Network》总结

- 论文阅读 - 《Neural Sentiment Classification with User and Product Attention》

- 《Learning Sentiment-Specific Word Embedding for Twitter Sentiment Classification》阅读笔记

- Hierarchical Attention Network for Document Classification阅读笔记

- Aspect Based Sentiment Analysis datasets

- 文献阅读之Attention-based Crowd Video Classification

- 论文笔记:Two-level attention model for fine-grained Image classification

- LSTM Networks for Sentiment

- 论文阅读 - 《Relation Classification via Multi-Level Attention CNNs》

- 阅读笔记(paper+code):Residual Attention Network for Image Classification

- 阅读笔记(paper+code):Residual Attention Network for Image Classification

- 【论文笔记】Relation Classification via Multi-Level Attention CNNs

- Theano-Deep Learning Tutorials 笔记:LSTM Networks for Sentiment Analysis

- LSTM Networks for Sentiment Analysis

- 论文笔记:Residual Attention Network for Image Classification

- ThinkPHP函数详解:import,vendor方法

- tensorflow全局变量初始化

- Shell脚本8种字符串截取方法总结

- 曼迪美记项目总结

- Python+OpenCV 程序暂停

- 《Attention-based LSTM for Aspect-level Sentiment Classification》阅读笔记

- Android7.0背光调节

- 聊聊ClassLoader

- QDU 礼尚往来(组合数学之错排公式)

- Nginx简介与安装

- 算法导论优先队列实现

- bzoj1076 [SCOI2008]奖励关

- jsp--学生信息管理系统

- 互联网神经学2016-2017研究报告,七个值得研究的颠覆性创新领域

2、实验结果

2、实验结果 TD-LSTM和TD-LSTM是Effective LSTMs for Target-Dependent Sentiment Classification这篇文章中提出的两个模型,具体介绍可以参考《Effective LSTMs for Target-Dependent Sentiment Classification》学习笔记。

TD-LSTM和TD-LSTM是Effective LSTMs for Target-Dependent Sentiment Classification这篇文章中提出的两个模型,具体介绍可以参考《Effective LSTMs for Target-Dependent Sentiment Classification》学习笔记。 图(a)中,输入句子为“I have to say they have one of the fastest delivery times in the city .” ,aspect为"service",

图(a)中,输入句子为“I have to say they have one of the fastest delivery times in the city .” ,aspect为"service",