KNL+FPGA是加速深度学习的黄金搭档

来源:互联网 发布:编歌词软件下载 编辑:程序博客网 时间:2024/05/18 03:44

【IT168 资讯】8月17日,在美国旧金山举行的英特尔信息技术峰会(Intel Developer Forum,简称IDF)上,浪潮首席科学家胡雷钧进行了先进技术报告演讲,他结合当前深度学习应用特点和先进计算技术架构进行分析,认为KNL+FPGA是加速深度学习的黄金搭档。

深度学习在人脸识别、语音识别、精准医疗以及无人驾驶等领域被广泛的应用,近年来在高性能计算技术的支持下,其发展十分迅速。然而,深度学习的发展也面临着众多困境,如深度学习软件扩展性不够高、计算性能不够高、深度学习线上识别能耗大等问题。

在多年的深度学习计算系统实践中,浪潮发现深度学习应用具备如下特点: 在进行线下的模型训练时,计算系统需要处理较大规模的数据量,所以训练时间非常长,它需要庞大的计算资源去训练一个模型;而当深度学习应用的相关服务或产品上线时,系统却因为要处理成千上万的人均访问量往往规模巨大,这时深度学习应用对能耗的控制需求就非常高。结合以上特点,浪潮首席科学家胡雷钧提出,深度学习平台构建应该根据线下训练和线上识别的不同应用特点分别定制开发高性能计算解决方案。

今年6月,英特尔推出新一代融核处理器Knights Landing(以下简称KNL)受到业内广泛关注,其具备多达 72 个核心,双精度浮点性能超过3TFlops,单精度则超过6TFlops,被认为是高性能计算和深度学习的革命性产品。胡雷钧认为,KNL的性能十分强大,非常合适做深度学习线下训练的平台构建。而对于能耗要求比较高的线上识别平台,胡雷钧认为可考虑采用FPGA,FPGA的能耗比是CPU的5倍以上,可大幅节省系统能耗,满足深度学习线上识别平台的构建需求。因此,采用KNL+FPGA的深度学习平台构建方案是加速深度学习应用的最佳组合。

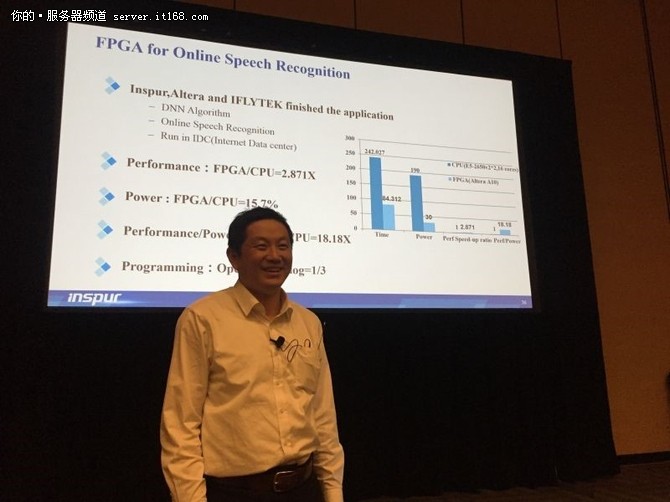

KNL+FPGA深度学习平台构建方案在浪潮的应用实践中得到了证实,浪潮曾全球首发基于最新KNL平台的深度学习计算框架Caffe-MPI。此外,浪潮联合科大讯飞和Altera用OpenCL实现的FPGA深度学习语音识别加速方案采用CPU+Altera Arria 10 FPGA异构架构,软件完全采用高级编程模式OpenCL实现从CPU到FPGA的迁移,在100 bound数据的处理条件下,基于Altera ARRIA 10 FPGA的DNN运行时间比基于Intel Xeon E5-2650 V2 双路CPU的性能加速2.871倍,在DNN 实际运行测试中,FPGA可实现30GFlops/W的高性能功耗比,而采用OpenCL编程模型使得最终的软件开发周期比传统verilog方式缩短了1/3.

浪潮作为领先的云计算、大数据和高性能计算服务商,其深度学习计算系统已经应用于百度、阿里巴巴、奇虎360、科大讯飞等多家互联网厂商,市场占有率超过60%。

- KNL+FPGA是加速深度学习的黄金搭档

- FPGA 深度学习CNN加速

- 深度学习的训练加速

- FPGA-as-a-Service:深度解析亚马逊的FPGA加速云

- FPGA在深度学习的未来

- FPGA在深度学习的未来

- 腾讯云FPGA的深度学习算法

- 深度学习FPGA实现基础知识3(Altera与百度展开合作在云数据中心使用FPGA加速)

- 建立FPGA深度学习加速生态圈,为人工智能赋能

- MobileNets—深度学习模型的加速

- 深度学习:优化加速

- 深度学习FPGA实现基础知识0(FPGA击败GPU和GPP,成为深度学习的未来?)

- 用于深度学习 的Xilinx FPGA XC7K325T PCIeX8 处理板卡

- 深度学习的最好方案,FPGA或GPU?

- 关于做深度学习 FPGA的几点考虑

- Facebook加速深度学习研发

- 深度学习模型压缩加速

- 我的黄金搭档们

- Base64编码

- Linux 自动加载驱动模块(.ko文件)

- TCP和UDP区别、联系

- java设计模式-策略模式

- 《深入理解java虚拟机》学习笔记(1)--jvm内存区域

- KNL+FPGA是加速深度学习的黄金搭档

- stm32在rt-thread上的RTC(实时时钟)

- 【opencv】 改变图像的对比度和亮度的两种方法

- 分布式系统事务一致性的几种解决方案简析

- Spring框架联系出现log4j:WARN No appenders could be found for logger (org.springframework.core.env.Standard

- Markdown编辑器使用方法

- JVM GC调优一则--增大Eden Space提高性能

- python-随笔

- git命令行删除远程分支和同步