【机器学习】逻辑回归(Linear Regression)模型推导

来源:互联网 发布:美国ip代理软件 编辑:程序博客网 时间:2024/06/15 02:57

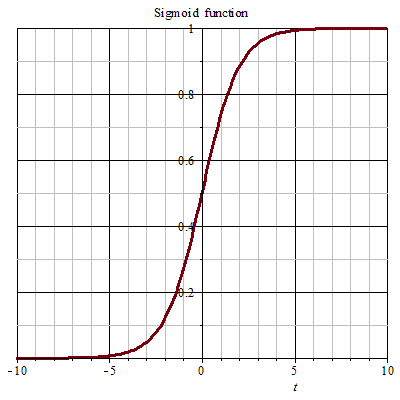

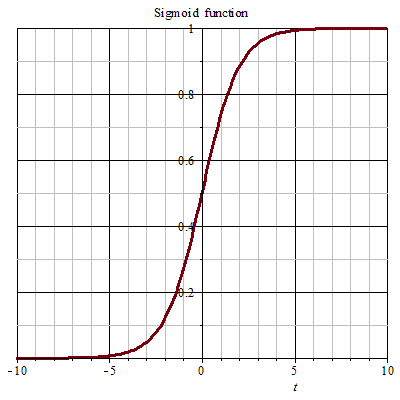

LR中文翻译作逻辑斯蒂回归,用于二分类。为什么回归和分类搅在一起了呢。因为可以这样想:线性回归 y=θTx 得到的结果是一个实数。如果我们将这个结果“压缩”到 [0,1] 之间,那么就可以表示概率接近1的程度,进而可以用来二分类。最简单的“压缩”可以是单位阶跃函数:

σ(x)=11+e−x

hθ(xi)=p(yi=1|xi)=σ(θTxi)=11+e−θTxi

p(yi=0|xi)=1−σ(θTxi)=e−θTxi1+e−θTxi

p(y|x)=(hθ(x))y(1−hθ(x))1−y

L(θ)=∏i=1mp(yi|xi)

l(θ)=logL(θ)=log∏i=1mp(yi|xi)=∑i=1mlogp(yi|xi)=∑i=1mlog[(hθ(xi))yi(1−hθ(xi))1−yi]=∑i=1m[yilog(hθ(xi))+(1−yi)log(1−hθ(xi))]=∑i=1m[yilog(g(θTxi))+(1−yi)log(1−g(θTxi))]

∂l(θ)∂θj=∑i=1m[yi1g∂g∂θj−(1−yi)11−g∂g∂θj]=∑i=1m[yi1gg′∂(θTxi)∂θj−(1−yi)11−gg′∂(θTxi)∂θj]=∑i=1m[yi1gg(1−g)xji−(1−yi)11−gg(1−g)xji]=∑i=1m(yi−g(θTxi))xji

θjk+1=θjk+η∑i=1m(yi−g(θTkxi))xji

但单位阶跃函数是不连续的,在求导的过程中会产生问题。所以,我们用sigmoid函数来近似单位阶跃函数:

可以看到,在0附近其函数值变化较快。

从而我们得到:

- 样本

xi 属于1的概率:

- 样本

xi 属于0的概率:

将两式合并:

对所有样本取最大似然:

记

取对数得:

sigmoid函数导数形式为:

参数第 j 个分量的梯度:

由于要求最大似然,所以用梯度上升法:

阅读全文

0 0

- 【机器学习】逻辑回归(Linear Regression)模型推导

- 机器学习:线性回归(Linear Regression)

- [小白式机器学习(一)] logistic regression(LR)对数几率回归 / 逻辑回归 公式推导

- [小白式机器学习(一)] logistic regression(LR)对数几率回归 / 逻辑回归 公式推导

- 机器学习-logistic Regression(逻辑回归)

- 机器学习模型——逻辑回归Logistic Regression

- 【机器学习 sklearn】逻辑斯蒂回归模型--Logistics regression

- 机器学习(1)---线性回归(Linear Regression)

- 机器学习(一)------- 线性回归(Linear regression )

- 斯坦福大学机器学习——线性回归(Linear Regression)

- 机器学习之线性回归(Linear Regression)

- 机器学习二-线性回归(linear regression)

- 机器学习:线性回归(Linear Regression)小项目

- 机器学习-----线性回归浅谈(Linear Regression)

- 机器学习之线性回归 Linear Regression(一)

- 【机器学习】线性回归Linear Regression

- 机器学习1 线性回归 Linear Regression

- (斯坦福机器学习课程笔记)用广义线性模型推导逻辑回归模型

- layui基本使用 -后台管理

- 骨牌填充

- Python3之Django Web框架首页分页处理升级版

- iOS Apple Pay开发流程

- 新手学习selenium路线图(老司机亲手绘制)

- 【机器学习】逻辑回归(Linear Regression)模型推导

- mysql字符串转换成时间格式

- 齐次坐标(homogeneous coordinate)

- 数据结构专题——栈与队列之顺序栈及其Java实现

- Faster rcnn 训练自己的数据—环境搭建

- Uboot的Makefil分析e

- xgboost参数详解

- NDI学习总结 JNDI数据源的配置

- Qt模块&头文件出现下划线问题