LogLog Counting

来源:互联网 发布:在淘宝上开店费用 编辑:程序博客网 时间:2024/05/29 18:43

上文介绍的Linear Counting算法相较于直接映射bitmap的方法能大大节省内存(大约只需后者1/10的内存),但毕竟只是一个常系数级的降低,空间复杂度仍然为

本文将介绍LogLog Counting。

简介

LogLog Counting(以下简称LLC)出自论文“Loglog Counting of Large Cardinalities”。LLC的空间复杂度仅有

基本算法

均匀随机化

与LC一样,在使用LLC之前需要选取一个哈希函数H应用于所有元素,然后对哈希值进行基数估计。H必须满足如下条件(定性的):

1、H的结果具有很好的均匀性,也就是说无论原始集合元素的值分布如何,其哈希结果的值几乎服从均匀分布(完全服从均匀分布是不可能的,D. Knuth已经证明不可能通过一个哈希函数将一组不服从均匀分布的数据映射为绝对均匀分布,但是很多哈希函数可以生成几乎服从均匀分布的结果,这里我们忽略这种理论上的差异,认为哈希结果就是服从均匀分布)。

2、H的碰撞几乎可以忽略不计。也就是说我们认为对于不同的原始值,其哈希结果相同的概率非常小以至于可以忽略不计。

3、H的哈希结果是固定长度的。

以上对哈希函数的要求是随机化和后续概率分析的基础。后面的分析均认为是针对哈希后的均匀分布数据进行。

思想来源

下面非正式的从直观角度描述LLC算法的思想来源。

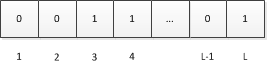

设a为待估集合(哈希后)中的一个元素,由上面对H的定义可知,a可以看做一个长度固定的比特串(也就是a的二进制表示),设H哈希后的结果长度为L比特,我们将这L个比特位从左到右分别编号为1、2、…、L:

又因为a是从服从均与分布的样本空间中随机抽取的一个样本,因此a每个比特位服从如下分布且相互独立。

通俗说就是a的每个比特位为0和1的概率各为0.5,且相互之间是独立的。

设

此时我们可以将

下面解释为什么可以这样估计。注意如下事实:

由于比特串每个比特都独立且服从0-1分布,因此从左到右扫描上述某个比特串寻找第一个“1”的过程从统计学角度看是一个伯努利过程,例如,可以等价看作不断投掷一个硬币(每次投掷正反面概率皆为0.5),直到得到一个正面的过程。在一次这样的过程中,投掷一次就得到正面的概率为

现在考虑如下两个问题:

1、进行n次伯努利过程,所有投掷次数都不大于k的概率是多少?

2、进行n次伯努利过程,至少有一次投掷次数等于k的概率是多少?

首先看第一个问题,在一次伯努利过程中,投掷次数大于k的概率为

显然第二个问题的答案是:

从以上分析可以看出,当

如果将上面描述做一个对应:一次伯努利过程对应一个元素的比特串,反面对应0,正面对应1,投掷次数k对应第一个“1”出现的位置,我们就得到了下面结论:

设一个集合的基数为n,

分桶平均

上述分析给出了LLC的基本思想,不过如果直接使用上面的单一估计量进行基数估计会由于偶然性而存在较大误差。因此,LLC采用了分桶平均的思想来消减误差。具体来说,就是将哈希空间平均分成m份,每份称之为一个桶(bucket)。对于每一个元素,其哈希值的前k比特作为桶编号,其中

这相当于物理试验中经常使用的多次试验取平均的做法,可以有效消减因偶然性带来的误差。

下面举一个例子说明分桶平均怎么做。

假设H的哈希长度为16bit,分桶数m定为32。设一个元素哈希值的比特串为“0001001010001010”,由于m为32,因此前5个bit为桶编号,所以这个元素应该归入“00010”即2号桶(桶编号从0开始,最大编号为m-1),而剩下部分是“01010001010”且显然

偏差修正

上述经过分桶平均后的估计量看似已经很不错了,不过通过数学分析可以知道这并不是基数n的无偏估计。因此需要修正成无偏估计。这部分的具体数学分析在“Loglog Counting of Large Cardinalities”中,过程过于艰涩这里不再具体详述,有兴趣的朋友可以参考原论文。这里只简要提一下分析框架:

首先上文已经得出:

因此:

这是一个未知通项公式的递推数列,研究这种问题的常用方法是使用生成函数(generating function)。通过运用指数生成函数和poissonization得到上述估计量的Poisson期望和方差为:

其中

最后通过depoissonization得到一个渐进无偏估计量:

其中:

其中m是分桶数。这就是LLC最终使用的估计量。

误差分析

不加证明给出如下结论:

其中

当m不太小(不小于64)时,

算法应用

误差控制

在应用LLC时,主要需要考虑的是分桶数m,而这个m主要取决于误差。根据上面的误差分析,如果要将误差控制在

内存使用分析

内存使用与m的大小及哈希值得长度(或说基数上限)有关。假设H的值为32bit,由于

合并

与LC不同,LLC的合并是以桶为单位而不是bit为单位,由于LLC只需记录桶的

小结

本文主要介绍了LogLog Counting算法,相比LC其最大的优势就是内存使用极少。不过LLC也有自己的问题,就是当n不是特别大时,其估计误差过大,因此目前实际使用的基数估计算法都是基于LLC改进的算法,这些改进算法通过一定手段抑制原始LLC在n较小时偏差过大的问题。后面要介绍的HyperLogLog Counting和Adaptive Counting就是这类改进算法。

- LogLog Counting

- 大数据下的基数估计(Linear Counting,LogLog Counting,HyperLogLog Counting,Adaptive Counting)

- 解读Cardinality Estimation算法(第三部分:LogLog Counting)

- 解读Cardinality Estimation算法(第三部分:LogLog Counting)

- loglog双对数坐标图

- matlab坐标轴函数 semilogx loglog

- [转]高压缩空间占用的 Hyper LogLog 算法

- 高压缩空间占用的 Hyper LogLog 算法

- 高压缩空间占用的 Hyper LogLog 算法

- 高压缩空间占用的 Hyper LogLog 算法

- [转]高压缩空间占用的 Hyper LogLog 算法

- [转]高压缩空间占用的 Hyper LogLog 算法

- 高压缩空间占用的 Hyper LogLog 算法

- Polya Counting

- Counting sort

- POJ_2386_Lake Counting

- Counting Sequences

- Counting-ACM

- ajax调用服务器方法,Sesstion过期的处理方法

- Linear Counting算法

- 树莓派3B+ Web服务器(LAMP)

- 每天一道算法题——从尾到头输出链表

- 算法:快速排序

- LogLog Counting

- 关于如何保持图片分辨率并压缩图片存储大小

- 求以邻接矩阵存储的有向无环图中的最长路径

- Unity 导航网格生成碰撞体

- commons-exec执行系统命令

- 笔记-2017.10.24

- 输入多组数据,输入0结束

- HyperLogLog Counting

- LeetCode 8. String to Integer (atoi)