17批标准化(Batch Normalization )

来源:互联网 发布:淘宝帮忙制作视频 编辑:程序博客网 时间:2024/05/29 05:02

批标准化(Batch Normalization )简称BN算法,是为了克服神经网络层数加深导致难以训练而诞生的一个算法。根据ICS理论,当训练集的样本数据和目标样本集分布不一致的时候,训练得到的模型无法很好的泛化。

而在神经网络中,每一层的输入在经过层内操作之后必然会导致与原来对应的输入信号分布不同,,并且前层神经网络的增加会被后面的神经网络不对的累积放大。这个问题的一个解决思路就是根据训练样本与目标样本的比例对训练样本进行一个矫正,而BN算法(批标准化)则可以用来规范化某些层或者所有层的输入,从而固定每层输入信号的均值与方差。

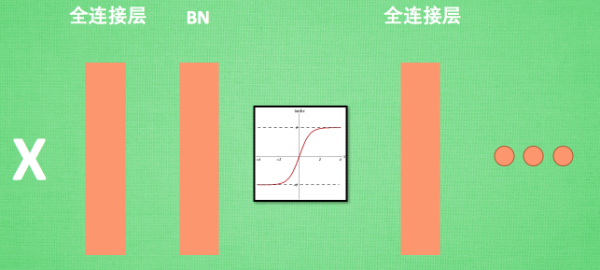

使用方法

批标准化一般用在非线性映射(激活函数)之前,对y= Wx + b进行规范化,是结果(输出信号的各个维度)的均值都为0,方差为1,让每一层的输入有一个稳定的分布会有利于网络的训练

在神经网络收敛过慢或者梯度爆炸时的那个无法训练的情况下都可以尝试

Batch normalization 的 batch 是批数据, 把数据分成小批小批进行 stochastic gradient descent. 而且在每批数据进行前向传递 forward propagation 的时候, 对每一层都进行 normalization 的处理,

计算公式

阅读全文

0 0

- 17批标准化(Batch Normalization )

- 3.1 Tensorflow: 批标准化(Batch Normalization)

- pytorch Batch Normalization批标准化

- 深度学习Deep Learning(05):Batch Normalization(BN)批标准化

- Batch Normalization(BN)

- 数据标准化(data normalization)

- 数据标准化(data normalization)

- BN(batch Normalization)笔记

- BN(Batch Normalization)要点

- Batch Normalization (理论+代码)

- 关于Batch Normalization(批归一化)的理解

- Batch Normalization

- Batch Normalization

- Batch Normalization

- batch normalization

- Batch Normalization

- Batch Normalization

- batch normalization

- 二进制文件和文本文件的区别

- Libpcap库主要函数

- loadrunner连接MySQL执行SQL语句

- 11月23日云栖精选夜读:阿里AI Labs王刚解读9小时卖出百万台的“天猫精灵” | 高山大学(GASA)

- 5.3 子类和对象

- 17批标准化(Batch Normalization )

- 将InputStream写入本地文件

- window10 下安装OpenCV tensorflow

- 【教程】html+css零基础入门教程之CSS选择器(二十五)

- 为VMWare中的Mac OS X 10.11硬盘扩容

- 理论经典:TCP协议的3次握手与4次挥手过程详解

- 深度学习攒机配置

- 【云周刊】第147期:解密天猫双11 1682亿背后的“霸下-七层流量清洗”系统

- cocos使用shader处理图片后位置变了