特征选择和特征抽取(学习小结)

来源:互联网 发布:中国房地产数据研究院 编辑:程序博客网 时间:2024/04/29 16:56

本篇博客的目的不是深刻的讲解特征提取和特征选择的方法,而是区分清楚他们之间的关系和区别,让大家对特征抽取 特征选择 PCA LDA有个概念框架上的了解,为大家的下一步的深入理解打好基础。 如果我的理解有问题,请大家提出意见,互相交流。

1.特征抽取 V.S 特征选择

特征抽取和特征选择是DimensionalityReduction(降维)的两种方法,针对于the curse of dimensionality(维灾难),都可以达到降维的目的。但是这两个有所不同。

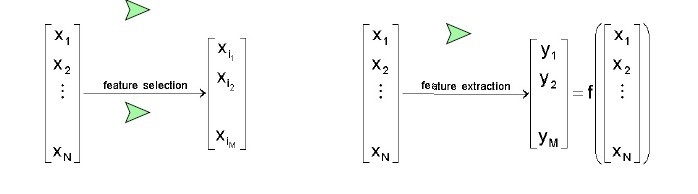

特征抽取(Feature Extraction):Creatting a subset of new features by combinations of the exsiting features.也就是说,特征抽取后的新特征是原来特征的一个映射。

特征选择(Feature Selection):choosing a subset of all the features(the ones more informative)。也就是说,特征选择后的特征是原来特征的一个子集。

2. PCA V.S LDA

主成分分析(Principle Components Analysis ,PCA)和线性评判分析(Linear Discriminant Analysis,LDA)是特征抽取的两种主要经典方法。

对于特征抽取,有两种类别:

(1)Signal representation(信号表示): The goal of the feature extraction mapping is to represent the samples accurately in a low-dimensional space. 也就是说,特征抽取后的特征要能够精确地表示样本信息,使得信息丢失很小。对应的方法是PCA.

(2)Signal classification(信号分类): The goal of the feature extraction mapping is toenhance the class-discriminatory information in a low-dimensional space. 也就是说,特征抽取后的特征,要使得分类后的准确率很高,不能比原来特征进行分类的准确率低。对与线性来说,对应的方法是LDA . 非线性这里暂时不考虑。

可见, PCA和LDA两种方法的目标不一样,因此导致他们的方法也不一样。PCA得到的投影空间是协方差矩阵的特征向量,而LDA则是通过求得一个变换W,使得变换之后的新均值之差最大、方差最大(也就是最大化类间距离和最小化类内距离),变换W就是特征的投影方向。

如果想进一步了解PCA,请见 http://blog.csdn.net/j123kaishichufa/article/details/7614234 点击打开链接

- 特征选择和特征抽取(学习小结)

- 特征选择和特征抽取(学习小结)

- 特征选择和特征抽取(学习小结)

- 特征选择和特征抽取 [uncompleted]

- 浅谈特征选择和特征抽取

- 特征选择与特征抽取

- 特征抽取与特征选择

- 特征抽取与特征选择

- 特征选择与特征抽取的区别

- sparkmllib 特征抽取、特征转换及特征选择

- 【特征工程】特征选择与特征学习

- 【特征工程】特征选择与特征学习

- 特征选择与特征学习

- 特征选择与特征学习

- 特征选择与特征学习

- 特征选择与特征学习

- 特征选择和特征理解

- 机器学习:特征工程之特征选择和学习

- Doxygen简单经验谈。。。

- Android工程的编译过程

- _beginthreadex,CreateThread,AfxBeginThread的区别

- FAT与NTFS

- android中操作SQLite常见错误

- 特征选择和特征抽取(学习小结)

- 64位机器的地址操作

- Android系统移植主要事项

- gridview中获取主键的值

- 在asp.net中将HTML代码写在后台的优点是什么?

- CSCOPE的使用

- CruiseControl使用记录

- C++调用Lua编程环境搭建及测试代码示例

- java处理加密文件---数字证书文件格式(cer和pfx)的区别