Stanford 机器学习 第一讲-------监督学习,无监督学习和半监督学习

来源:互联网 发布:javascript 权威指南 编辑:程序博客网 时间:2024/05/24 00:43

n Supervised Learning 有监督学习

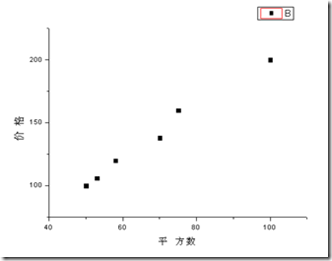

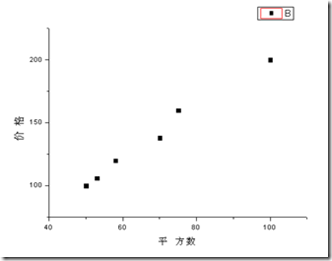

机器学习按照学习方式的不同,分为supervised learning和unsupervised learning,这里先介绍Supervised Learning即有监督学习,举一个简单的例子,假设你想卖房子,但是你不知道怎么定价,而你有附近其他房子的定价信息。让x轴为平方数,y轴为价格,我们得到下面这个图,在图中我们看到价格数和平方数好像可以用一条直线拟合,那么得到这条直线方程后我便可以根据我的房子的评分数来让机器给我一个合适的价格数。

嗯,这其实就是一个有监督学习,所谓有监督学习简单来说就是我们提供了数据集,提供了问题的输入和问题的确切输出结果,然后利用样本数据“监督”机器来学习输入和输出之间的关系(在上面的例子中,这个关系好像是一条直线方程)。

Unsupervised Learning 无监督学习

和有监督学习相对的是无监督学习,所谓无监督学习,简单的理解就是我给你一堆数据一堆特征,你给我产出一些有意义的东西,从数据里面找到一些结构。最简单的例子就是将人进行人群的划分,我们无法给出人群类别的准确定义,但是我们可以利用无监督学习帮我们找到这样一个又一个的人群(可能你周围几个人就是一个小群体),这就是所谓的聚类分析。在这个部分,课程通过图片内像素点的聚类结果来展现无监督学习的效果和应用,同时一个声音识别也是通过无监督学习来实现(为什么是无监督学习?你可以思考下。)

n 半监督学习

在这节课中,我们初步了解了机器学习是什么,能干什么,同时也学习到机器学习的两类学习问题:supervised learning 和 unsupervised learning,实际上还有一种称为半监督学习(即semi-supervised learning),实际上它是监督学习和无监督学习相结合的一种新学习方法,它主要考虑如何利用少量的有标注样本(监督)和大量的未标注样本(无监督)来完成分类或回归问题。因为如果只有少量的有标注数据来做supervised learning,那么机器学习出来的模型肯定是有偏的或者模型的泛化能力不好(在有限的知识下我们人类也无法很好的对未知的事物做出准确的判断),同时这也是在做机器学习中需要注意的一点,即样本的质量问题,样本的质量包括样本大小,样本标注质量,样本分布等等。

在现实环境中,有标注数据往往是少量并难以获得,而未标注的数据则是大量并难以利用的,所以如何利用大量的未标记示例来改善学习性能已成为当前机器学习研究中最受关注的问题之一,半监督学习就是其中一种方法(还有直推学习和主动学习,这里暂时不深究)。半监督学习实际上对所有数据(标注和未标注)的分布情况做了一些假设,假设数据间存在的一定的结构,这些结构让未标注的数据能合并到已标注数据的标注结果中,主要包括下面两种假设:

n 监督学习和无监督学习

那么什么时候该应用监督学习,什么时候该使用无监督学习呢?从这两个概念的定义出发,我们很轻松的可以知道,当样本或者数据有明确输入和明确输出结果时,我们可以使用监督学习,监督学习最常见的包括回归问题和分类问题,而无监督学习则常见为聚类问题。但是现实中很多情况下需要我们去构造样本,可以通过人工标注的方法,明确数据的输出,再将问题作为监督学习来解决,也可以先利用无监督学习,对数据做预处理后再结合人工标注等方法最终进行有监督学习。但是说起来容易,实际上不管在做监督学习或无监督学习,很多机器学习方面的技巧或者细节都可能对结果有巨大影响,比如当你选用的样本有偏或者样本分布不均或者样本数据并不是独立同分布时,那么这时候使用有监督学习得到的模型就会产生较大误差。

n 机器学习

机器学习听起来似乎十分简单,将待解决的问题确定为某一类问题后,就可以选用模型来训练样本数据,得到预测模型后便可以应用到实际数据中。但是没有深厚的数学基础以及对各种模型的理解,还有丰富的机器学习经验,是无法做好一个机器学习的任务的。

(1)这个问题是机器学习中的哪类问题

(2)这个问题可以转化为机器学习中的其他类问题吗

(3)这个问题既然是机器学习中的A类问题,那么选择什么样的模型来解决这个问题呢

(4)为什么选择这个模型而不是选择那个模型?是因为样本问题?因为模型泛化能力问题?因为??

(5)这个模型的本质数学理论是如何?是否合适这个问题?

(6)这个训练结果为什么会这样?是模型问题?是样本问题?

(7)做训练前,你考虑过样本问题吗?

(8)做训练时,你的特征时如何选取的?

(9)完成训练后,你如何评估你的结果?

(10)等等

作者:Aga.J

出处:http://www.cnblogs.com/aga-j

机器学习按照学习方式的不同,分为supervised learning和unsupervised learning,这里先介绍Supervised Learning即有监督学习,举一个简单的例子,假设你想卖房子,但是你不知道怎么定价,而你有附近其他房子的定价信息。让x轴为平方数,y轴为价格,我们得到下面这个图,在图中我们看到价格数和平方数好像可以用一条直线拟合,那么得到这条直线方程后我便可以根据我的房子的评分数来让机器给我一个合适的价格数。

嗯,这其实就是一个有监督学习,所谓有监督学习简单来说就是我们提供了数据集,提供了问题的输入和问题的确切输出结果,然后利用样本数据“监督”机器来学习输入和输出之间的关系(在上面的例子中,这个关系好像是一条直线方程)。

Unsupervised Learning 无监督学习

和有监督学习相对的是无监督学习,所谓无监督学习,简单的理解就是我给你一堆数据一堆特征,你给我产出一些有意义的东西,从数据里面找到一些结构。最简单的例子就是将人进行人群的划分,我们无法给出人群类别的准确定义,但是我们可以利用无监督学习帮我们找到这样一个又一个的人群(可能你周围几个人就是一个小群体),这就是所谓的聚类分析。在这个部分,课程通过图片内像素点的聚类结果来展现无监督学习的效果和应用,同时一个声音识别也是通过无监督学习来实现(为什么是无监督学习?你可以思考下。)

n 半监督学习

在这节课中,我们初步了解了机器学习是什么,能干什么,同时也学习到机器学习的两类学习问题:supervised learning 和 unsupervised learning,实际上还有一种称为半监督学习(即semi-supervised learning),实际上它是监督学习和无监督学习相结合的一种新学习方法,它主要考虑如何利用少量的有标注样本(监督)和大量的未标注样本(无监督)来完成分类或回归问题。因为如果只有少量的有标注数据来做supervised learning,那么机器学习出来的模型肯定是有偏的或者模型的泛化能力不好(在有限的知识下我们人类也无法很好的对未知的事物做出准确的判断),同时这也是在做机器学习中需要注意的一点,即样本的质量问题,样本的质量包括样本大小,样本标注质量,样本分布等等。

在现实环境中,有标注数据往往是少量并难以获得,而未标注的数据则是大量并难以利用的,所以如何利用大量的未标记示例来改善学习性能已成为当前机器学习研究中最受关注的问题之一,半监督学习就是其中一种方法(还有直推学习和主动学习,这里暂时不深究)。半监督学习实际上对所有数据(标注和未标注)的分布情况做了一些假设,假设数据间存在的一定的结构,这些结构让未标注的数据能合并到已标注数据的标注结果中,主要包括下面两种假设:

n 监督学习和无监督学习

那么什么时候该应用监督学习,什么时候该使用无监督学习呢?从这两个概念的定义出发,我们很轻松的可以知道,当样本或者数据有明确输入和明确输出结果时,我们可以使用监督学习,监督学习最常见的包括回归问题和分类问题,而无监督学习则常见为聚类问题。但是现实中很多情况下需要我们去构造样本,可以通过人工标注的方法,明确数据的输出,再将问题作为监督学习来解决,也可以先利用无监督学习,对数据做预处理后再结合人工标注等方法最终进行有监督学习。但是说起来容易,实际上不管在做监督学习或无监督学习,很多机器学习方面的技巧或者细节都可能对结果有巨大影响,比如当你选用的样本有偏或者样本分布不均或者样本数据并不是独立同分布时,那么这时候使用有监督学习得到的模型就会产生较大误差。

n 机器学习

机器学习听起来似乎十分简单,将待解决的问题确定为某一类问题后,就可以选用模型来训练样本数据,得到预测模型后便可以应用到实际数据中。但是没有深厚的数学基础以及对各种模型的理解,还有丰富的机器学习经验,是无法做好一个机器学习的任务的。

(1)这个问题是机器学习中的哪类问题

(2)这个问题可以转化为机器学习中的其他类问题吗

(3)这个问题既然是机器学习中的A类问题,那么选择什么样的模型来解决这个问题呢

(4)为什么选择这个模型而不是选择那个模型?是因为样本问题?因为模型泛化能力问题?因为??

(5)这个模型的本质数学理论是如何?是否合适这个问题?

(6)这个训练结果为什么会这样?是模型问题?是样本问题?

(7)做训练前,你考虑过样本问题吗?

(8)做训练时,你的特征时如何选取的?

(9)完成训练后,你如何评估你的结果?

(10)等等

作者:Aga.J

出处:http://www.cnblogs.com/aga-j

- Stanford 机器学习 第一讲-------监督学习,无监督学习和半监督学习

- 机器学习(二):有监督学习、无监督学习和半监督学习

- 机器学习:监督学习和无监督学习

- 机器学习:监督学习和无监督学习

- 机器学习之监督学习和无监督学习

- 机器学习笔记1---监督学习和无监督学习

- 机器学习 监督学习和无监督学习

- 机器学习(1)监督学习和无监督学习

- 监督学习?无监督学习?

- 监督学习&无监督学习

- 监督学习、无监督学习、半监督学习、强化学习

- 监督学习和无监督学习

- 监督学习和无监督学习

- 监督学习和无,监督学习区别

- 监督学习和无监督学习

- 监督学习和无监督学习

- 监督学习和无监督学习

- 监督学习和无监督学习

- 判断一个数是否为对称的数

- 兼容IE6 7 8 chrome firefox图片水平垂直居中

- 商店应用的进程模型 -- 管理App

- Android回顾之数据存储

- yum出错Error: Cannot find a valid baseurl for repo: base

- Stanford 机器学习 第一讲-------监督学习,无监督学习和半监督学习

- 我见过的关于notify()和notifyAll()区别的最简洁的代码

- spring静态变量注入

- 企业云集成平台MuleSoft获5000万美元融资

- 关于QGis编译

- 一步步学习SPD2010--第九章节--使用可重用工作流和工作流表单(10)--修改初始表单参数

- 内部排序之五:计数排序、基数排序和桶排序

- Xcode磁盘空间大清理

- nor flash 与 nand flash 区别