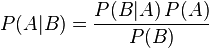

【机器学习算法-python实现】扫黄神器-朴素贝叶斯分类器的实现

来源:互联网 发布:淘宝九宫格在线制作 编辑:程序博客网 时间:2024/05/17 00:04

(转载请注明出处:http://blog.csdn.net/buptgshengod)

1.背景

2.数据集

[['my','dog','has','flea','problems','help','please'], 0

['maybe','not','take','him','to','dog','park','stupid'], 1

['my','dalmation','is','so','cute','I','love','him'], 0

['stop','posting','stupid','worthless','garbage'], 1

['mr','licks','ate','my','steak','how','to','stop','him'], 0

['quit','buying','worthless','dog','food','stupid']] 1

3.代码

#以矩阵形式创建数据集def loadDataSet(): postingList=[['my', 'dog', 'has', 'flea', 'problems', 'help', 'please'], ['maybe', 'not', 'take', 'him', 'to', 'dog', 'park', 'stupid'], ['my', 'dalmation', 'is', 'so', 'cute', 'I', 'love', 'him'], ['stop', 'posting', 'stupid', 'worthless', 'garbage'], ['mr', 'licks', 'ate', 'my', 'steak', 'how', 'to', 'stop', 'him'], ['quit', 'buying', 'worthless', 'dog', 'food', 'stupid']] classVec = [0,1,0,1,0,1] #1 is abusive, 0 not return postingList,classVec

#将矩阵内容添加到列表,set获取list中不重复的元素def createVocabList(dataSet): vocabSet = set([]) #create empty set for document in dataSet: vocabSet = vocabSet | set(document) #union of the two sets return list(vocabSet)

#判断list中每个词在总共词语list中的位置def setOfWords2Vec(vocabList, inputSet): returnVec = [0]*len(vocabList) for word in inputSet: if word in vocabList: returnVec[vocabList.index(word)] = 1 else: print "the word: %s is not in my Vocabulary!" % word return returnVec

def trainNB0(trainMatrix,trainCategory): numTrainDocs = len(trainMatrix) numWords = len(trainMatrix[0]) pAbusive = sum(trainCategory)/float(numTrainDocs)#脏句的比例 p0Num = zeros(numWords); p1Num = zeros(numWords) #zero是numpy带的函数,zeros(i)长度为i的list p0Denom = 0.0; p1Denom = 0.0 for i in range(numTrainDocs): if trainCategory[i] == 1:#如果是粗口句,每个词在p1num加一 p1Num += trainMatrix[i] p1Denom += sum(trainMatrix[i]) else: p0Num += trainMatrix[i] p0Denom += sum(trainMatrix[i]) p1Vect = p1Num/p1Denom #粗口字概率 p0Vect = p0Num/p0Denom return p0Vect,p1Vect,pAbusive

实现效果:

[ 0. 0. 0. 0.05263158 0.05263158 0. 0.

0. 0.05263158 0.05263158 0. 0. 0.

0.05263158 0.05263158 0.05263158 0.05263158 0.05263158 0.

0.10526316 0. 0.05263158 0.05263158 0. 0.10526316

0. 0.15789474 0. 0.05263158 0. 0. 0. ]

出现概率最大项:

0.157894736842

对应的词是:stupid

['cute', 'love', 'help', 'garbage', 'quit', 'I', 'problems', 'is', 'park', 'stop', 'flea', 'dalmation', 'licks', 'food', 'not', 'him', 'buying', 'posting', 'has', 'worthless', 'ate', 'to', 'maybe', 'please', 'dog', 'how', 'stupid', 'so', 'take', 'mr', 'steak', 'my']

4.下载

- 【机器学习算法-python实现】扫黄神器-朴素贝叶斯分类器的实现

- 【机器学习算法-python实现】扫黄神器-朴素贝叶斯分类器的实现

- 《机器学习实战》基于朴素贝叶斯分类算法构建文本分类器的Python实现

- <基础原理进阶>机器学习算法python实现【3】--文本分析之朴素贝叶斯分类器

- 机器学习算法-朴素贝叶斯Python实现

- 朴素贝叶斯分类算法的Python实现

- 机器学习实战——python实现简单的朴素贝叶斯分类器

- 机器学习算法的R语言实现(三):朴素贝叶斯分类器

- 机器学习之朴素贝叶斯(NB)分类算法与Python实现

- 朴素贝叶斯分类器的python实现

- 机器学习经典算法详解及Python实现---朴素贝叶斯分类及其在文本分类、垃圾邮件检测中的应用

- 机器学习经典算法详解及Python实现---朴素贝叶斯分类及其在文本分类、垃圾邮件检测中的应用

- 朴素贝叶斯分类算法python实现

- 机器学习及python实现——朴素贝叶斯分类器

- 机器学习算法python实现---朴素贝叶斯算法(朴素Bayes)

- Python机器学习库SKLearn分类算法之朴素贝叶斯

- 机器学习:朴素贝叶斯算法+中文情感分类+python

- 机器学习专题(二)—— 朴素贝叶斯算法的python实现

- lua内置函数库

- 宽字符与char*相互转换函数

- 一个简单的投票程序

- mybatis开发环境配置

- 在framework中添加字符串资源

- 【机器学习算法-python实现】扫黄神器-朴素贝叶斯分类器的实现

- 彻底搞定C指针--“函数名与函数指针”

- J2ME中如何使用drawString()

- Ubuntu14.04+eclipse下cocos2d-x3.0正式版环境的搭建

- ZOJ-1954

- hdu 1506 Largest Rectangle in a Histogram

- haproxy 配置 说明

- codeforces 426/A

- Java 5种字符串拼接方式性能比较。