OpenCV人脸识别facerec

来源:互联网 发布:jenkins 修改端口号 编辑:程序博客网 时间:2024/05/17 12:52

人脸辨认

从OpenCV2.4开始,加入了新的类FaceRecognizer,我们可使用它便捷地进行人脸辨认实验。其源代码可以在OpenCV中的opencvmodulescontribdocfacerecsrc下找到。

目前支持的算法有:

Eigenfaces特点脸createEigenFaceRecognizer()

Fisherfaces createFisherFaceRecognizer()

Local Binary Patterns Histograms局部2值直方图 createLBPHFaceRecognizer()

自动人脸辨认就是如何从1幅图象中提取成心义的特点,把它们放入1种有用的表示方式,然后对他们进行1些分类。

特点脸方法描写了1个全面的方法来辨认人脸:脸部图象是1个点,这个点是从高维图象空间找到它在低维空间的表示,这样分类变得很简单。低维子空间低维是使用主元分析(Principal Component Analysis,PCA)找到的,它可以找具有最大方差的那个轴。虽然这样的转换是从最好重建角度斟酌的,但是他没有把标签问题斟酌进去。想象1个情况,如果变化是基于外部来源,比如光照。轴的最大方差不1定包括任何有鉴别性的信息,因此此时的分类是不可能的。因此,1个使用线性鉴别(Linear Discriminant Analysis,LDA)的特定类投影方法被提出来解决人脸辨认问题。其中1个基本的想法就是,

最近几年来,各种局部特点提取方法出现。为了不输入的图象的高维数据,仅仅使用的局部特点描写图象的方法被提出,提取的特点(很有希望的)对局部遮挡、光照变化、小样本等情况更强健。有关局部特点提取的方法有盖伯小波(Gabor Waelets),离散傅立叶变换(Discrete Cosinus Transform,DCT),局部2值模式(Local Binary Patterns,LBP)。使用甚么方法来提取时域空间的局部特点照旧是1个开放性的研究问题,由于空间信息是潜伏有用的信息。

局部2值模式直方图Local Binary Patterns Histograms

由于Eigenfaces和Fisherfaces两种方法当引入新的人脸数据时需要重新进行训练,所以这里我侧重介绍LBP特点的有关内容。

Eigenfaces和Fisherfaces使用整体方法来进行人脸辨认[gm:直接使用所有的像素]。你把你的数据当作图象空间的高维向量。我们都知道高维数据是糟的,所以1个低维子空间被肯定,对信息保存可能很好。Eigenfaces是最大化总的散度,这样可能致使,当方差由外部条件产生时,最大方差的主成份不合适用来分类。所以为使用1些鉴别分析,我们使用了LDA方法来优化。Fisherfaces方法可以很好的运作,最少在我们假定的模型的有限情况下。

现实生活是不完善的。你没法保证在你的图象中光照条件是完善的,或说1个人的10张照片。所以,如果每人仅仅只有1张照片呢?我们的子空间的协方差估计方法可能完全毛病,所以辨认也可能毛病。

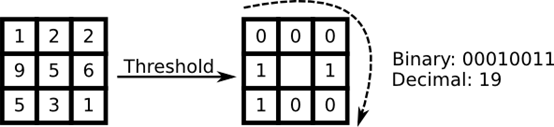

1些研究专注于图象局部特点的提取。主张是我们不把全部图象看成1个高维向量,仅仅用局部特点来描写1个物体。通过这类方式提取特点,你将取得1个低维隐式。1个好主张!但是你很快发现这类图象表示方法不单单遭受光照变化。你想一想图象中的尺度变化、形变、旋转―我们的局部表示方式最少对这些情况比较稳健。正如SIFT,LBP方法在2D纹理分析及第足轻重。LBP的基本思想是对图象的像素和它局部周围像素进行对照后的结果进行求和。把这个像素作为中心,对相邻像素进行阈值比较。如果中心像素的亮度大于等于他的相邻像素,把他标记为1,否则标记为0。你会用2进制数字来表示每一个像素,比如11001111。因此,由于周围相邻8个像素,你终究可能获得2^8个可能组合,被称为局部2值模式,有时被称为LBP码。第1个在文献中描写的LBP算籽实际使用的是3*3的邻域。

算法描写

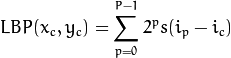

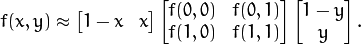

1个更加正式的LBP操作可以被定义为:

其中(xc,yc)是中心像素,亮度是ic;而in是相邻像素的亮度。s是1个符号函数。

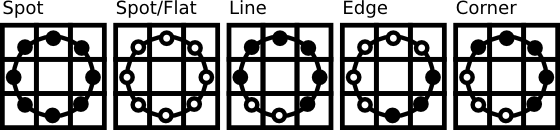

这类描写方法使得你可以很好的捕捉到图象中的细节。实际上,研究者们可以用它在纹理分类上得到最早进的水平。正如刚才描写的方法被提出后,固定的近邻区域对尺度变化的编码失效。所以,使用1个变量的扩大方法是使用可变半径的圆对近邻像素进行编码,这样可以捕捉到以下的近邻:

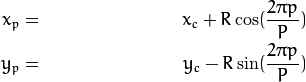

对1个给定的点(xc,yc),他的近邻点(xp,yp),p∈P可以由以下计算:

其中,R是圆的半径,而P是样本点的个数。

这个操作是对原始LBP算子的扩大,所以有时被称为扩大LBP(又称为圆形LBP)。如果1个在圆上的点不在图象坐标上,我们使用他的内插点。计算机科学有1堆聪明的插值方法,而OpenCV使用双线性插值。

LBP算子,对灰度的单调变化很稳健。我们可以看得手工改变后的图象的LBP图象。

那末剩下来的就是如何合并空间信息用于人脸辨认模型。

* elbp函数用于生成lbp图象。

* spatial_histogram函数用于将lbp图象分块,对每个区块进行直方图统计。

LBPH的预测进程

下面给出了LBPH预测函数predict的源码,再进行分析。

预测进程就比较简单了,首先将待查询点图象进行lbp编码并生成空间直方图,然后线性暴力的计算直方图的距离,终究输出距离最小的预测种别。

vector<Mat> images;vector<int> labels;// images for first personimages.push_back(imread("person0/0.jpg", CV_LOAD_IMAGE_GRAYSCALE));labels.push_back(0);images.push_back(imread("person0/1.jpg", CV_LOAD_IMAGE_GRAYSCALE));labels.push_back(0);// images for second personimages.push_back(imread("person1/0.jpg", CV_LOAD_IMAGE_GRAYSCALE));labels.push_back(1);images.push_back(imread("person1/1.jpg", CV_LOAD_IMAGE_GRAYSCALE));labels.push_back(1);Ptr<FaceRecognizer> model = createFisherFaceRecognizer(); model->train(images, labels);Mat img = imread("person1/2.jpg", CV_LOAD_IMAGE_GRAYSCALE);int predicted = model->predict(img);- OpenCV人脸识别facerec

- 【计算机视觉】OpenCV人脸识别facerec源码分析1——FaceRecognizer概述

- 【计算机视觉】OpenCV人脸识别facerec源码分析2——LBPH概述

- OpenCV人脸识别facerec源码分析2――LBPH概述

- 【计算机视觉】OpenCV人脸识别facerec源码分析1——FaceRecognizer概述

- 【计算机视觉】OpenCV人脸识别facerec源码分析2——LBPH概述

- OpenCV人脸识别facerec源码分析——FaceRecognizer概述

- OpenCV人脸识别facerec源码分析2——LBPH概述

- 【计算机视觉】OpenCV人脸识别facerec源码分析2——LBPH概述

- 【计算机视觉】OpenCV人脸识别facerec源码分析2——LBPH概述

- 利用facerec代码包中的eigenface进行人脸识别

- OpenCV人脸识别

- opencv人脸识别

- openCV人脸识别

- Opencv 人脸识别

- opencv人脸识别

- Opencv 人脸识别

- opencv 人脸识别

- configure: error: in `/usr/local/src/php-5.6.9':

- TCP的三次握手和四次挥手

- Java构造和解析Json数据的两种方法详解一

- 下载地址

- 8大排序之-----(一)插入排序与时间复杂度

- OpenCV人脸识别facerec

- 这道题目其实很容易,刚刚开始的时候,我不知道连续是怎么证明的,到了最后,我看了答案,首先求出在该点的值,然后再求出趋于改点的值

- IPC通信:Posix共享内存1

- Java中类的实例化方式

- 音视频之路之开篇——视音频编解码技术零基础学习方法

- C++宏定义详解

- 关于TexturePacker的使用

- js实现百度搜索

- Jetty 的工作原理以及与 Tomcat 的比较