四分钟将1000万数据插入mysql数据库

来源:互联网 发布:网络英语课 编辑:程序博客网 时间:2024/04/27 15:45

我用到的数据库为,mysql数据库5.7版本的

1.首先自己准备好数据库表

其实我在插入1000万条数据的时候遇到了一些问题,现在先来解决他们,一开始我插入100万条数据时候报错,控制台的信息如下:

com.mysql.jdbc.PacketTooBigException: Packet for query is too large (4232009 > 4194304). You can change this value on the server by setting the max_allowed_packet’ variable.

出现上面的错误是因为数据库表的 max_allowed_packet这个配置没配置足够大,因为默认的为4M的,后来我调为100M就没报错了

set global max_allowed_packet = 100*1024*1024*

记住,设置好后重新登录数据库才能看的设置后的值show VARIABLES like '%max_allowed_packet%'

Java的jdbc代码如下:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

43

44

45

46

47

48

49

50

51

52

53

54

55

56

57

58

59

60

61

62

63

64

65

66

67

68

69

70

71

package insert;import java.sql.Connection;import java.sql.DriverManager;import java.sql.SQLException;import java.util.Date;import com.mysql.jdbc.PreparedStatement;public class InsertTest { public static void main(String[] args) throws ClassNotFoundException, SQLException { final String url = "jdbc:mysql://127.0.0.1/teacher"; final String name = "com.mysql.jdbc.Driver"; final String user = "root"; final String password = "123456"; Connection conn = null; Class.forName(name);//指定连接类型 conn = DriverManager.getConnection(url, user, password);//获取连接 if (conn!=null) { System.out.println("获取连接成功"); insert(conn); }else { System.out.println("获取连接失败"); } } public static void insert(Connection conn) { // 开始时间 Long begin = new Date().getTime(); // sql前缀 String prefix = "INSERT INTO t_teacher (id,t_name,t_password,sex,description,pic_url,school_name,regist_date,remark) VALUES "; try { // 保存sql后缀 StringBuffer suffix = new StringBuffer(); // 设置事务为非自动提交 conn.setAutoCommit(false); // 比起st,pst会更好些 PreparedStatement pst = (PreparedStatement) conn.prepareStatement("");//准备执行语句 // 外层循环,总提交事务次数 for (int i = 1; i <= 100; i++) { suffix = new StringBuffer(); // 第j次提交步长 for (int j = 1; j <= 100000; j++) { // 构建SQL后缀 suffix.append("('" + uutil.UUIDUtil.getUUID()+"','"+i*j+"','123456'"+ ",'男'"+",'教师'"+",'www.bbk.com'"+",'XX大学'"+",'"+"2016-08-12 14:43:26"+"','备注'" +"),"); } // 构建完整SQL String sql = prefix + suffix.substring(0, suffix.length() - 1); // 添加执行SQL pst.addBatch(sql); // 执行操作 pst.executeBatch(); // 提交事务 conn.commit(); // 清空上一次添加的数据 suffix = new StringBuffer(); } // 头等连接 pst.close(); conn.close(); } catch (SQLException e) { e.printStackTrace(); } // 结束时间 Long end = new Date().getTime(); // 耗时 System.out.println("1000万条数据插入花费时间 : " + (end - begin) / 1000 + " s"); System.out.println("插入完成"); }}结果:

哈哈,1000万条数据288秒完成,是不是感觉超级牛逼,我每次插入10万条数据就提交一次事务,如果是一条一条差的话估计要好几个小时,网上有人试过时间浪费在数据库的连接上了,

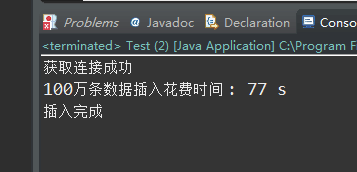

后来我想测试插入100万条数据时候数据库引擎的差别

首先把代码中最外层的循环i=100改为i=10;

1.数据库引擎为MyISAM时:27s,这个我忘了截图了。因为我后来测试InnoDB的时候我换了一个表来测试,因为我发现改不了数据库表的引擎。。。。所以只能换一个表来测试

1.数据库引擎为InnoDB时:

用了77秒,比MyISAW慢了3倍左右,估计要是1000万条数据的时候更慢吧。。。 0 0

- 四分钟将1000万数据插入mysql数据库

- 绝对干货,教你4分钟插入1000万条数据到mysql数据库表

- 4分钟插入1000万条数据到mysql数据库表

- 3分钟左右的时间如何向MySQL数据库中插入100万条数据

- 1分钟oracle 数据库按天插入60万数据和按天删除60万数据

- 批量将数据插入MySQL数据库的PHP代码

- java读取大文本直接插入Mysql数据库,10万条数据4秒执行完

- RadioButton [将数据插入数据库]

- MySql数据库插入数据乱码

- 插入数据到MySql数据库

- Log4Net记录日志到数据库启动24小时后将无法向mysql数据库插入数据

- oracle数据库同步,100万数据秒级插入

- 向数据库插入10万数据的存储函数

- php操作mysql迅速插入上百万数据

- mysql 如何将行数插入到数据库

- SQLite初识(四)数据库插入数据

- MYSQL常用命令(四) 将文本数据转到数据库中/备份数据库

- 通过表单将数据插入数据库

- redis在Linux安装报错

- WEB前端超多知识总结

- Spring Security学习笔记

- MySQL进阶漂流记(四)

- Dubbo的配置及使用

- 四分钟将1000万数据插入mysql数据库

- excel-java(maven)

- python day4(20170223)

- 堆排序详解以及JAVA实现

- 百度地图 带小红点 可以拖拽 查看经纬度

- S2 体检项目

- replica character liquid crystal display control

- jar包冲突解决(getTextContent()方法无法找到)

- python day5(20170224 )