Deeplearning toolbox 中如何实现sparse/stack/denoise autoencoder (转载)

来源:互联网 发布:淘宝对接什么意思 编辑:程序博客网 时间:2024/06/08 08:27

转载来源:http://blog.sina.com.cn/s/blog_4a1853330102vupf.html

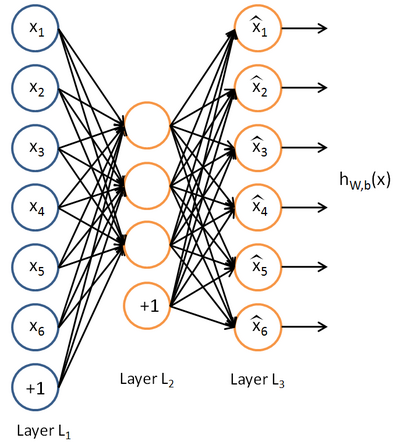

先放一张autoencoder的基本结构:

基本意思就是一个隐藏层的神经网络,输入输出都是x,属于无监督学习

==========================================================================================

基本代码

saesetup.m

- function

sae = saesetup(size) -

for u = 2 : numel(size) -

sae.ae{u-1} = nnsetup([size(u-1) size(u) size(u-1)]); -

end - end

saetrain.m

- function

sae = saetrain(sae, x, opts) -

for i = 1 : numel(sae.ae); -

disp(['Training AE ' num2str(i) '/'num2str(numel(sae.ae))]); -

sae.ae{i} = nntrain(sae.ae{i}, x, x, opts); -

t = nnff(sae.ae{i}, x, x); -

x = t.a{2}; -

%remove bias term -

x = x(:,2:end); -

end - end

其实就是每一层一个autoencoder,隐藏层的值作为下一层的输入

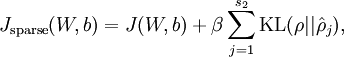

sparse autoencoder:

denoising autoencoder:

Contractive Auto-Encoders:

jacobian(self,x):

_jacobi_loss():

_fit_reconstruction():

这几个函数和autoencoder有出入,其实也比较简单,就不细讲了

总结:

总的来说,autoencoder感觉是DL中比较好理解的一部分,所以介绍内容不长

可能你也发现了,Toolbox里还有一个文件夹叫CAE,不过这个CAE是Convolutional

Auto-Encoders

参考http://www.idsia.ch/~ciresan/data/icann2011.pdf,以后有时间再学习一下~

- Deeplearning toolbox 中如何实现sparse/stack/denoise autoencoder (转载)

- Deeplearning学习之路_第一章(Sparse Autoencoder)

- 卷积stack autoencoder(转载)

- Denoise Autoencoder

- 深度学习(三)denoise autoencoder的Python实现

- sparse-autoencoder

- Sparse Autoencoder

- Deeplearning Toolbox中CNN代码学习

- UFLDL学习笔记1(Sparse Autoencoder)

- UFLDL教程 Exercise:Sparse Autoencoder(答案)

- 稀疏自动编码(Sparse Autoencoder)

- 稀疏自动编码器 (Sparse Autoencoder)

- Autoencoder ,Sparse Coding ,Sparse autoencoder 简介

- Deep Learning模型之:Denoise Autoencoder

- Deep learning:四十二(Denoise Autoencoder简单理解)

- 深度学习(二)sparse autoencoder的Python实现

- UFLDL练习(Sparse Autoencoder)

- Deep learning:(Sparse Autoencoder)

- PullToRefreshScrolleView

- Keepalived+Nginx架构配置

- 1.2.3

- java5、java6、java7、java8的新特性

- Session原理解释,为什么使用session

- Deeplearning toolbox 中如何实现sparse/stack/denoise autoencoder (转载)

- 13 Linux touch

- 云虚拟主机+WordPress搭建个人博客(图文)

- jQuery ajax 提交表单一例

- 西安电子科技大学硕士论文latex模板第1章修改为第一章

- 逆波兰 计算器 C语言实现

- linux 关机命令总结

- ES6__异步开发优化

- 信息安全论学习笔记(二):密码学基础