关于混合高斯、EM和K-means

来源:互联网 发布:网络电视 卡不卡 编辑:程序博客网 时间:2024/06/05 02:45

与k-means一样,给定的训练样本是![]() ,我们将隐含类别标签用

,我们将隐含类别标签用![]() 表示。与k-means的硬指定不同,我们首先认为

表示。与k-means的硬指定不同,我们首先认为![]() 是满足一定的概率分布的,这里我们认为满足多项式分布,

是满足一定的概率分布的,这里我们认为满足多项式分布,![]() ,其中

,其中![]() ,

,![]() 有k个值{1,…,k}可以选取。而且我们认为在给定

有k个值{1,…,k}可以选取。而且我们认为在给定![]() 后,

后,![]() 满足多值高斯分布,即

满足多值高斯分布,即![]() 。由此可以得到联合分布

。由此可以得到联合分布![]() 。

。

![]() ,我们先从k个类别中按多项式分布抽取一个

,我们先从k个类别中按多项式分布抽取一个![]() ,然后根据

,然后根据![]() 所对应的k个多值高斯分布中的一个生成样例

所对应的k个多值高斯分布中的一个生成样例![]() ,。整个过程称作混合高斯模型。注意的是这里的

,。整个过程称作混合高斯模型。注意的是这里的![]() 仍然是隐含随机变量。模型中还有三个变量

仍然是隐含随机变量。模型中还有三个变量![]() 和

和![]() 。最大似然估计为

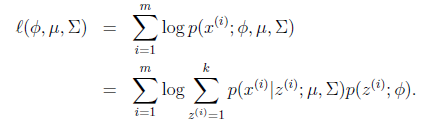

。最大似然估计为![]() 。对数化后如下:

。对数化后如下:

![]() ,那么上式可以简化为:

,那么上式可以简化为:

![]() 和

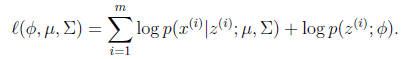

和![]() 进行求导得到:

进行求导得到:

![]() 就是样本类别中

就是样本类别中![]() 的比率。

的比率。![]() 是类别为j的样本特征均值,

是类别为j的样本特征均值,![]() 是类别为j的样例的特征的协方差矩阵。

是类别为j的样例的特征的协方差矩阵。

实际上,当知道![]() 后,最大似然估计就近似于高斯判别分析模型(Gaussian discriminant analysis model)了。所不同的是GDA中类别y是伯努利分布,而这里的z是多项式分布,还有这里的每个样例都有不同的协方差矩阵,而GDA中认为只有一个。

后,最大似然估计就近似于高斯判别分析模型(Gaussian discriminant analysis model)了。所不同的是GDA中类别y是伯努利分布,而这里的z是多项式分布,还有这里的每个样例都有不同的协方差矩阵,而GDA中认为只有一个。

![]() ,实际上

,实际上![]() 是不知道的。那么怎么办呢?考虑之前提到的EM的思想,第一步是猜测隐含类别变量z,第二步是更新其他参数,以获得最大的最大似然估计。用到这里就是:

是不知道的。那么怎么办呢?考虑之前提到的EM的思想,第一步是猜测隐含类别变量z,第二步是更新其他参数,以获得最大的最大似然估计。用到这里就是:

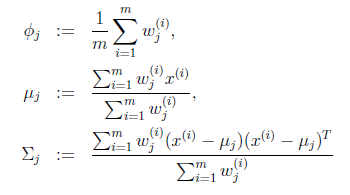

循环下面步骤,直到收敛: {

![]()

}

![]() 看作常量,计算

看作常量,计算![]() 的后验概率,也就是估计隐含类别变量。估计好后,利用上面的公式重新计算其他参数,计算好后发现最大化最大似然估计时,

的后验概率,也就是估计隐含类别变量。估计好后,利用上面的公式重新计算其他参数,计算好后发现最大化最大似然估计时,![]() 值又不对了,需要重新计算,周而复始,直至收敛。

值又不对了,需要重新计算,周而复始,直至收敛。

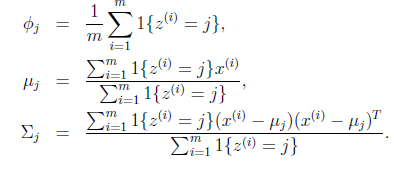

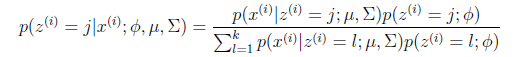

![]() 的具体计算公式如下:

的具体计算公式如下:

![]() 代替了前面的

代替了前面的![]() ,由简单的0/1值变成了概率值。

,由简单的0/1值变成了概率值。

![]() 是有一定的概率的,同时计算量也变大了,每个样例i都要计算属于每一个类别j的概率。与K-means相同的是,结果仍然是局部最优解。对其他参数取不同的初始值进行多次计算不失为一种好方法。

是有一定的概率的,同时计算量也变大了,每个样例i都要计算属于每一个类别j的概率。与K-means相同的是,结果仍然是局部最优解。对其他参数取不同的初始值进行多次计算不失为一种好方法。

下面累述一下K-means与EM的关系,首先回到初始问题,我们目的是将样本分成k个类,其实说白了就是求每个样例x的隐含类别y,然后利用隐含类别将x归类。由于我们事先不知道类别y,那么我们首先可以对每个样例假定一个y吧,但是怎么知道假定的对不对呢?怎么评价假定的好不好呢?我们使用样本的极大似然估计来度量,这里是就是x和y的联合分布P(x,y)了。如果找到的y能够使P(x,y)最大,那么我们找到的y就是样例x的最佳类别了,x顺手就聚类了。但是我们第一次指定的y不一定会让P(x,y)最大,而且P(x,y)还依赖于其他未知参数,当然在给定y的情况下,我们可以调整其他参数让P(x,y)最大。但是调整完参数后,我们发现有更好的y可以指定,那么我们重新指定y,然后再计算P(x,y)最大时的参数,反复迭代直至没有更好的y可以指定。

![]() 对应隐含变量也就是最佳类别

对应隐含变量也就是最佳类别![]() 。最开始可以随便指定一个

。最开始可以随便指定一个![]() 给它,然后为了让P(x,y)最大(这里是要让J最小),我们求出在给定c情况下,J最小时的

给它,然后为了让P(x,y)最大(这里是要让J最小),我们求出在给定c情况下,J最小时的![]() (前面提到的其他未知参数),然而此时发现,可以有更好的

(前面提到的其他未知参数),然而此时发现,可以有更好的![]() (质心与样例距

(质心与样例距![]() 离最小的类别)指定给样例

离最小的类别)指定给样例![]() ,那么

,那么![]() 得到重新调整,上述过程就开始重复了,直到没有更好的

得到重新调整,上述过程就开始重复了,直到没有更好的![]() 指定。这样从K-means里我们可以看出它其实就是EM的体现,E步是确定隐含类别变量

指定。这样从K-means里我们可以看出它其实就是EM的体现,E步是确定隐含类别变量![]() ,M步更新其他参数

,M步更新其他参数![]() 来使J最小化。这里的隐含类别变量指定方法比较特殊,属于硬指定,从k个类别中硬选出一个给样例,而不是对每个类别赋予不同的概率。总体思想还是一个迭代优化过程,有目标函数,也有参数变量,只是多了个隐含变量,确定其他参数估计隐含变量,再确定隐含变量估计其他参数,直至目标函数最优。

来使J最小化。这里的隐含类别变量指定方法比较特殊,属于硬指定,从k个类别中硬选出一个给样例,而不是对每个类别赋予不同的概率。总体思想还是一个迭代优化过程,有目标函数,也有参数变量,只是多了个隐含变量,确定其他参数估计隐含变量,再确定隐含变量估计其他参数,直至目标函数最优。

- 关于混合高斯、EM和K-means

- 高斯混合模型中的K-means和EM

- 13.k-means聚类,混合高斯,EM算法

- 第12节-K-means算法,高斯混合分布和EM求解算法

- 机器学习(八)——在线学习、K-Means算法、混合高斯模型和EM算法

- 斯坦福ML公开课笔记12——K-Means、混合高斯分布、EM算法

- 机器学习系列(4):混合高斯模型+EM+K-means算法

- 斯坦福ML公开课笔记12——K-Means、混合高斯分布、EM算法

- K-means与高斯混合模型

- 高斯混合模型聚类算法和K-Means聚类算法

- K-means算法、高斯混合模型 matlab

- 混合高斯模型和EM算法

- 高斯混合模型和EM算法

- 高斯混合模型GMM和EM

- 高斯混合模型和EM

- GMM&K-means&EM

- 混合高斯模型(应用和EM算法)

- 混合高斯模型mixture Gaussians和EM算法

- 智能路由器:忽悠,还是变革

- Hessian学习

- js控制浏览器

- 全局 CSS

- Maven插件安装

- 关于混合高斯、EM和K-means

- PROC系列之---/proc/loadavg

- win2008 asp IIS

- gradeview可拖动效果实现

- 八极拳 八大招

- express安装成功创建项目的时候出现错误的解决方案

- 图的广度优先搜索(BFS)

- android开发问题集锦

- eclipse 修改jre