局部权重线性回归(Locally weighted linear regression)

来源:互联网 发布:单片机plc哪个好学 编辑:程序博客网 时间:2024/04/30 11:05

在线性回归中,由于对参数个数选择的问题是在问题求解之前已经确定好的,因此参数的个数不能很好的确定,如果参数个数过少可能拟合度不好,产生欠拟合(underfitting)问题,或者参数过多,使得函数过于复杂产生过拟合问题(overfitting)。因此本节介绍的局部线性回归(LWR)可以减少这样的风险。

欠拟合与过拟合

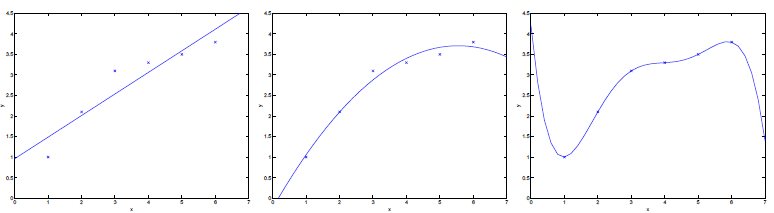

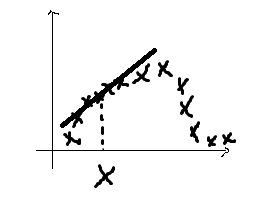

首先看下面的图

对于图中的一系列样本点,当我们采用 形式,便会产生最右边的拟合曲线。从三张图中我们可以看出来,第一条曲线存在欠拟合问题,第三条的曲线存在过拟合问题。

形式,便会产生最右边的拟合曲线。从三张图中我们可以看出来,第一条曲线存在欠拟合问题,第三条的曲线存在过拟合问题。

局部权重线性回归(Locally weighted linear regression)

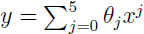

在基本的线性回归问题中,首先我们构造出预测函数h(x),然后变化参数θ使得误差函数最小化,一旦θ确定,以后不会改变,所有的预测值都会使用着一个参数:

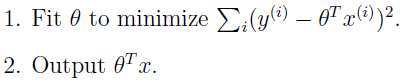

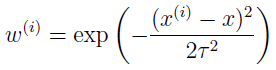

相比之下,局部权重线性回归方法执行如下的算法:

x代表需要预测的值的输入,

w中的τ称为带宽(bandwidth)参数,可以控制x周围的概念,即控制距离x多远可以参与线性函数的估计,τ越大,参与的点越多,反之,参与的点越少。

由于局部权重线性回归方法每个预测每一个点时候都需要重新计算一次

θ的值,因此,算法费时间复杂度会很高,是一种non-parametric算法。前面的基本线性回归是一种parametric学习算法。

个人博客:http://www.houlaizhexq.com houlaizhexq.github.io

0 0

- 局部权重线性回归(Locally weighted linear regression)

- 局部权重线性回归(Locally weighted linear regression)

- 局部加权线性回归(Locally weighted linear regression)

- 局部线性回归(Locally Weighted Linear Regression)

- 局部加权线性回归(Locally weighted linear regression)

- Locally weighted linear regression(局部加权线性回归)

- Locally weighted linear regression局部加权线性回归

- 局部加权回归(Locally weighted linear regression)

- 局部加权回归(Locally weighted linear regression)

- 局部加权回归、欠拟合、过拟合(Locally Weighted Linear Regression、Underfitting、Overfitting)

- 局部加权回归LOESS(locally weighted regression)

- 3 Locally weighted linear regression, logistic Regression

- 机器学习笔记(一)-局部加权回归(Locally weighted regression)LWR

- 机器学习系列-Locally weighted linear regression(2)

- Linear Regression 线性回归

- linear regression 线性回归

- 线性回归 Linear Regression

- Linear regression(线性回归)

- spfa模板 hdu 2544

- Android 动态生成布局 (多层嵌套)

- 单源最短路问题BellMan-Ford算法C++实现关键代码

- android基础02:eclipse集成SVN插件subclipse

- Greatest Number

- 局部权重线性回归(Locally weighted linear regression)

- 【BZOJ】【P2440】【中山市选2011】【完全平方数】【题解】【莫比乌斯反演】

- 快速素数判断的方法

- Java回调函数的理解

- Core Java 8 学习笔记(三) 输入输出

- github简单使用教程

- Android strings.xml资源文件 使用技巧

- 判断网页是否有效(404)

- 《Java并发编程实战》第九章 图形用户界面应用程序界面 读书笔记