hadoop启动后,长久不用,无法关闭

来源:互联网 发布:react.js阮一峰 编辑:程序博客网 时间:2024/05/24 11:14

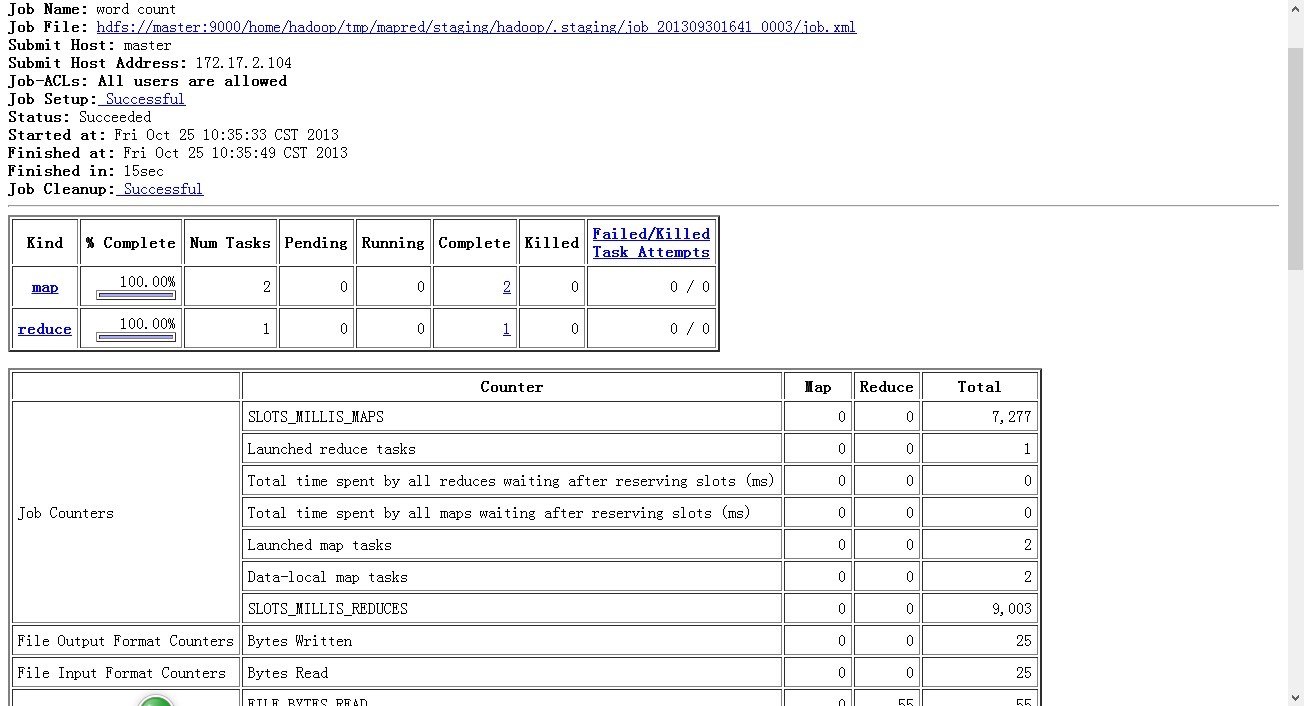

上次配好了hadoop的环境,已经大概过去一周了,查看hadoop的运行情况:

上次配好了hadoop的环境,已经大概过去一周了,查看hadoop的运行情况:

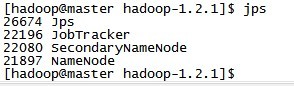

在master节点上查看jps状态:

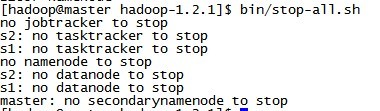

执行停止命令的时候发现下面情况:

在网上查了一些资料觉得下面的解释比较靠谱:

出现这个问题的最常见原因是hadoop在stop的时候依据的是datanode上的mapred和dfs进程号。而默认的进程号保存在/tmp下,linux默认会每隔一段时间(一般是一个月或者7天左右)去删除这个目录下的文件。因此删掉hadoop-hadoop-jobtracker.pid和hadoop-hadoop-namenode.pid两个文件后,namenode自然就找不到datanode上的这两个进程了。

另外还有两个原因可能引起这个问题:

1:环境变量 $HADOOP_PID_DIR 在你启动hadoop后改变了

2:用另外的用户身份执行stop-all

解决方法:

1:永久解决方法,修改$HADOOP_HOME/conf/hadoop-env.sh里边,去掉export HADOOP_PID_DIR=/var/hadoop/pids的#号,创建/var/hadoop/pids或者你自己指定目录

发现问题后的解决方法:

1:这个时候通过脚本已经无法停止进程了,不过我们可以手工停止,方法是到各mfs master和各datanode执行ps -ef | grep java | grep hadoop找到进程号强制杀掉,然后在master执行start-all脚本重新启动,就能正常启动和关闭了。

0 0

- hadoop启动后,长久不用,无法关闭

- hadoop无法正常关闭,不用格式化正常恢复

- 启动Hadoop后发现datanode无法启动

- MongoDB非正常关闭后无法启动

- 数据库异常关闭后无法启动(hellodba)

- Eclipse 异常关闭后,无法启动解决

- eclipse异常关闭后,无法启动

- VMware非正常关闭后无法启动

- Eclipse非正常关闭后无法启动

- 【Hadoop】关于hadoop正常启动而无法正常关闭

- Hadoop启动后无法看到DataNode

- 修改hostname后无法启动hadoop

- Hadoop安装后dataNode无法启动

- 【hadoop】hadoop启动后jps无法查看守护进程

- Hadoop之——正常启动而无法正常关闭

- hadoop集群启动后datanode和namenodemanager关闭问题解决

- 数据库异常关闭后无法启动问题处理(ORA-01102)

- mongoDB非正常关闭后无法启动问题

- 【Unity&C#】运行在主线程的Socket

- 用c语言读一张图片

- 同步和互斥

- 笔试携程经验

- Tsinsen A1127 方格取数

- hadoop启动后,长久不用,无法关闭

- Mysql 不同版本 说明

- SQL语言基础入门总结

- javaEE

- JAVA常用运算符极其运算优先级的总结

- 《剑指Offer》学习笔记——重建二叉树

- 第6周项目4-静态成员应用

- 第6周项目2:带武器的游戏角色

- 关于const