深度学习之caffe 前向传播和反向传播

来源:互联网 发布:阿里云学生签到 编辑:程序博客网 时间:2024/05/19 02:02

前向传播和反向传播在caffe框架中是Net(查看我的博客中的net那边介绍的博客)模型中最基本的计算.

以线性回归分类器为例,

前向传播可以简单理解为根据给定的输入计算输出。

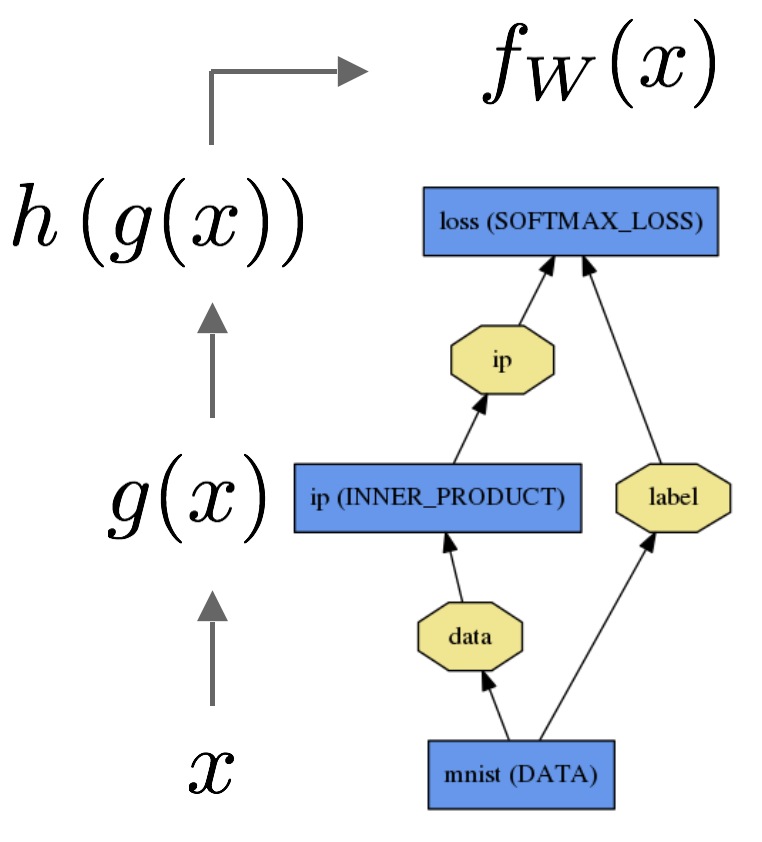

在caffe中,通过组合每一个layer层的计算(如果大家在中学阶段接触过复合函数,例如f(x)=h(g(x))这种形式,那么大家就好理解了)来表示整个神经网络模型,传播方式是自底向上(bottom to top,所以我们称作前向传播).如下图所示。

反向传播:由于我们需要根据输入的数据进行学习,因此我们不断调整神经网络中的神经元(以权值矩阵W表示),一种好的解决方案就是利用计算给定损失函数的梯度.

损失函数一般可以定义为:Loss=(t-f(Xn;w0,w1,...wn))^2,这里需要说明的是t表示我们最终期望的输出,f表示神经网络的实际输出。当然这里只是粗略的给出了一个简单线性分类问题的损失函数,实际情况下损失函数一般比较。

那么有了损失函数Loss,我们就可以运用高等数学中的知识来求解梯度gradient.

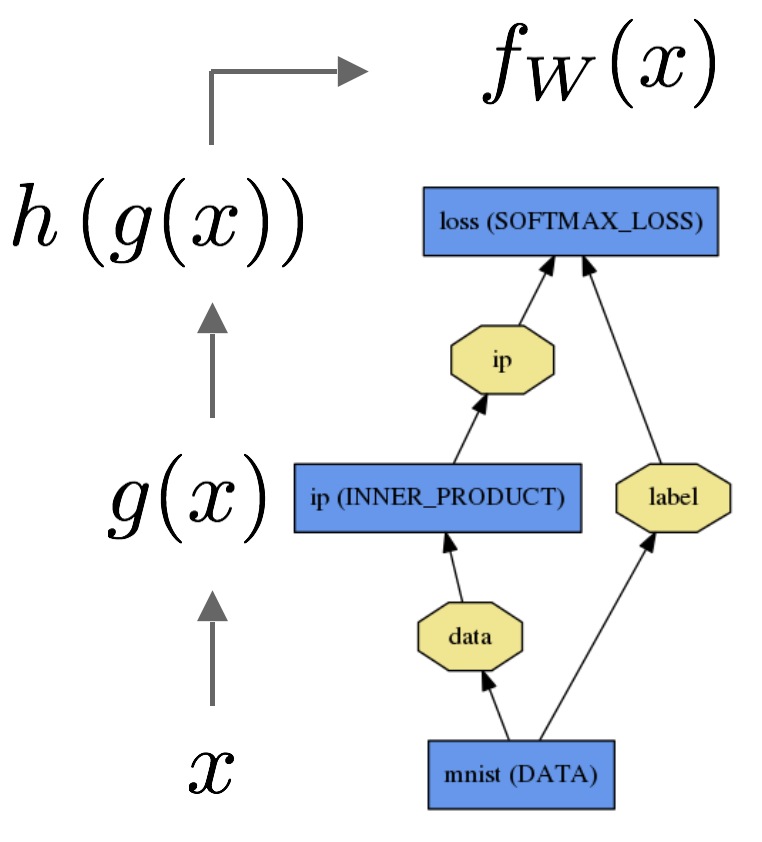

对于上图的反向传播,可以用下图表示.

首先,从损失函数loss开始,计算关于输出

,通过偏微分求导的链式法则,不断的往前面的层计算梯度,并最终传到输入层。

反向传播算法具体比较繁琐,如果有机会,我以后会专门写一个反向传播算法的章节。

0 0

- 深度学习之caffe 前向传播和反向传播

- caffe学习笔记3.2--前向传播和反向传播

- caffe学习笔记3.2--前向传播和反向传播

- Caffe源码解读:relu_layer前向传播和反向传播

- 深度学习:神经网络中的前向传播和反向传播算法推导

- C++从零实现深度神经网络之二——前向传播和反向传播

- Caffe tutorial 之 前向与反向传播

- 无意义-深度学习前向反向传播笔记

- 深度卷积神经网络学习笔记2:步长不为1的卷积前向传播和反向传播

- 深度学习21天实战Caffe学习笔记--笔记5--caffe中前向传播、反向传播及最优化求解过程

- 深度学习21天实战Caffe学习笔记--笔记5--caffe中前向传播、反向传播及最优化求解过程

- 神经网络中前向传播和反向传播解析

- 前向传播和反向传播(举例说明)

- 深度学习系列(2):前向传播和后向传播算法

- 前向传播与反向传播代码

- 深度学习反向传播

- Caffe源码解读: SoftmaxLayer的前向与反向传播

- Caffe源码解读: Softmax_loss_Layer的前向与反向传播

- NSIndexPath的初始化方法

- 简单的openVPN部署 (证书登录以及用户名密码认证)

- 视频直播

- c/c++日志程序

- C++11 并发指南三(Lock 详解)

- 深度学习之caffe 前向传播和反向传播

- Kotlin:出现Unresolved reference:kolinx问题的解决办法

- C#Winform实现程序关闭隐藏窗体,二次程序启动时显示

- vim实用技巧

- http://blog.csdn.net/achellies/article/details/7034740

- Ionic单独使用转场动画

- HDFS学习笔记(7)mapreduce

- C++11 并发指南七(C++11 内存模型一:介绍)

- 三轴加速计中一阶低通滤波算法