5分钟学会使用DataHub接入实时数据到MaxCompute(原ODPS)

来源:互联网 发布:dotamax数据不更新 编辑:程序博客网 时间:2024/06/04 19:28

免费开通大数据服务:https://www.aliyun.com/product/odps

DataHub服务是MaxCompute提供的流数据服务, 并提供把实时数据准实时归档到MaxCompute中功能, 在延时上可以做到5分钟数据在MaxCompute中可见;相对于MaxCompute之前提供的批量数据接口Tunnel实时性有了极大的提高。本文简要介绍如何快速通过DataHub创建实时数据写入MaxCompute的数据通道。

准备MaxCompute表

假设我们准备的MaxCompute表是如下结构

create table test_stream_in (data string) partitioned by (ds string);快速、完全托管的TB/PB级数据仓库解决方案,向用户提供了完善的数据导入方案以及多种经典的分布式计算模型,能够更快速的解决用户海量数据计算问题,有效降低企业成本,并保障数据安全。

了解更多

登录DataHub Web控制台进行操作

弹内的DataHub服务web控制台地址地址:https://datahub.console.aliyun.com/datahub

目前请使用AK登录。

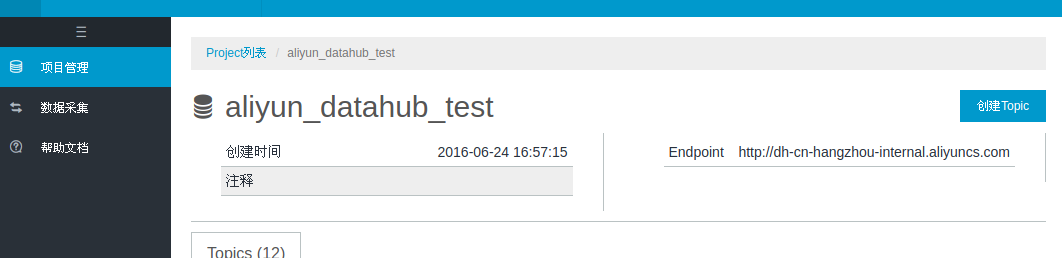

进入创建Project详情页面, 点击创建Topic

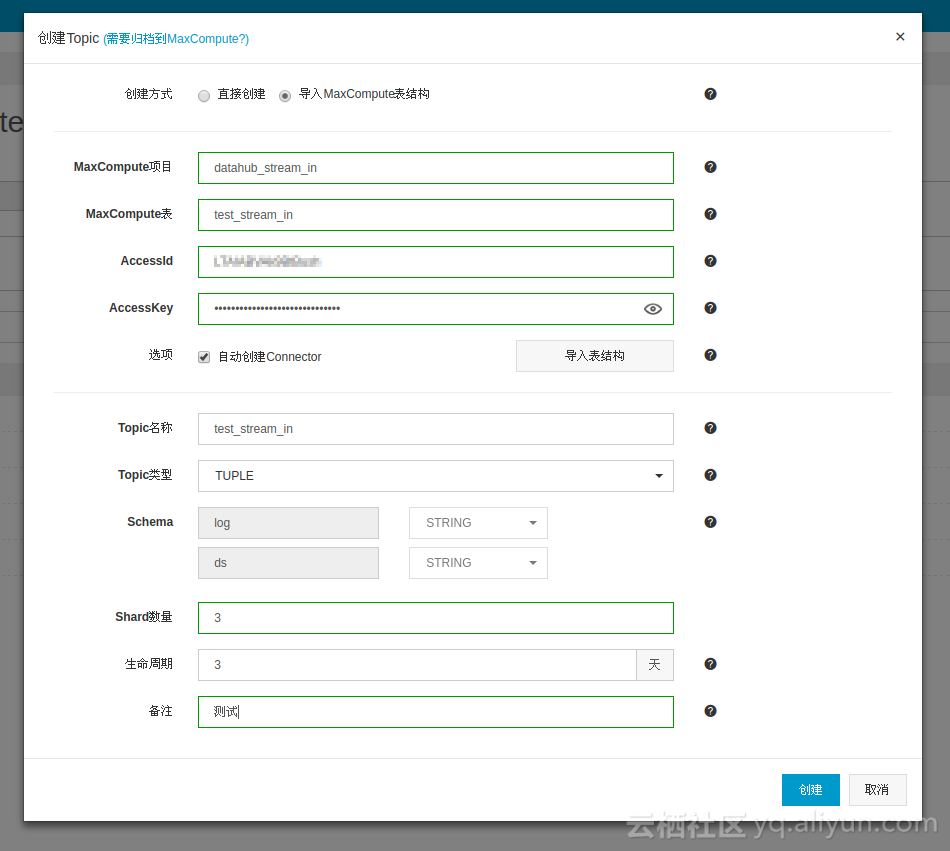

在弹出的选项卡中进行如下操作

- 创建方式 选中 “导入MaxCompute表结构”

- 填写我们需要写入的MaxComputed项目,MaxCompute表,AccessId,AccessKey 信息

- 在选项中勾选上 “自动创建Connector”

- 然后点击导入表结构,可以看到MaxCompute表的结构就自动填到了Topic选项中

- 填写Topic名称,Shard数量,生命周期,备注等

- 点击创建

查看创建成功的Topic和Connector

现在就可以在Topic的列表中查询到我们之前创建的Topic,并且这个Topic已经默认创建了一个归档MaxCompute的Connector。

使用SDK/工具写入实时数据

原文链接:

0 0

- 5分钟学会使用DataHub接入实时数据到MaxCompute(原ODPS)

- Logstash + DataHub + MaxCompute/StreamCompute 进行实时数据分析

- MaxCompute(原ODPS)使用总结-初级篇

- MaxCompute 2.0—从ODPS到MaxCompute

- MaxCompute 2.0—从ODPS到MaxCompute

- MaxCompute(原ODPS) 事件(Event)机制

- MaxCompute(原ODPS) MapReduce常见问题解答

- 使用 MaxCompute(原ODPS) java sdk 运行安全相关命令

- 【大数据干货】数据进入阿里云数加-大数据计算服务MaxCompute(原ODPS)的N种方式

- 使用 odps-jdbc 接入 ODPS,不再从零开始

- PgSQL · 最佳实践 · 从 MaxCompute (ODPS) 迁移数据到 HybridDB

- Odps(MaxCompute)使用时一些问题

- MaxCompute(原ODPS)任务优化之列裁剪

- MaxCompute(原ODPS) 脑图 - 常用知识总结

- MaxCompute( 原ODPS)下的表分区解释

- 从MapReduce的执行来看如何优化MaxCompute(原ODPS) SQL

- 三分钟教你学会分析MaxCompute消费明细

- Hadoop数据迁到MaxCompute

- C 和C++ 对定义结构体的区别

- laravel validator验证

- DDL、DML和DCL的区别与理解

- Android知识点之延迟加载:ViewStub的使用

- Android 去掉标题栏,状态栏,导航栏

- 5分钟学会使用DataHub接入实时数据到MaxCompute(原ODPS)

- iOS 自定义转场动画初探

- java 集合ArrayList及LinkList源码分析

- Android UI 手机信息页面(作业)

- POJ 3926 Parade(DP)

- .Net MVC JsonResult 序列化长度限制问题

- phpmyadmin配置

- Maven 私服的搭建(Nexus)

- 删除mysql数据库中本地数据库失败的解决方法