斯坦福大学公开课 :机器学习课程(Andrew Ng)——10、无监督学习:Mixture of Gaussians and the EM Algorithm

来源:互联网 发布:mac系统word 编辑:程序博客网 时间:2024/06/06 19:34

1)问题定义

2)混合高斯模型

3)EM算法

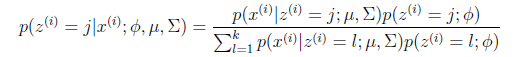

这篇讨论使用期望最大化算法(Expectation-Maximization)来进行密度估计(density estimation)【即混合高斯模型中的隐含随机变量![]() =j的概率

=j的概率![]() 】。

】。

1)问题定义

与k-means一样,给定的训练样本是![]() ,我们将隐含类别标签用

,我们将隐含类别标签用![]() 表示。与k-means的硬指定不同,我们首先认为

表示。与k-means的硬指定不同,我们首先认为![]() 是满足一定的概率分布的,这里我们认为满足多项式分布,

是满足一定的概率分布的,这里我们认为满足多项式分布,![]() ,其中

,其中![]() ,

,![]() 有k个值{1,…,k}可以选取。而且我们认为在给定

有k个值{1,…,k}可以选取。而且我们认为在给定![]() 后,

后,![]() 满足多元高斯分布,即

满足多元高斯分布,即![]() 。对应联合概率分布为

。对应联合概率分布为![]() 。

。

2)混合高斯模型

整个模型简单描述为对于每个样例![]() ,我们先从k个类别中按多项式分布抽取一个

,我们先从k个类别中按多项式分布抽取一个![]() ,然后根据

,然后根据![]() 所对应的k个多元高斯分布中的一个生成样例

所对应的k个多元高斯分布中的一个生成样例![]() ,这个过程称作混合高斯模型。注意的是这里的

,这个过程称作混合高斯模型。注意的是这里的![]() 仍然是隐含随机变量。模型中还有三个变量

仍然是隐含随机变量。模型中还有三个变量![]() 和

和![]() 。最大似然估计为

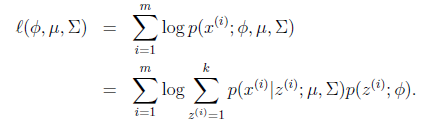

。最大似然估计为![]() 。对数化后如下:

。对数化后如下:

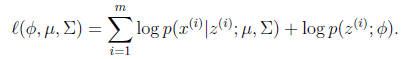

这个式子的最大值是不能通过前面使用的求导数为0的方法解决的,因为求得的结果不是close form(即,没有闭合解,无法通过解析方式算出)。但是假设我们知道了每个样例的![]() ,那么上式可以简化为(想一想为什么可以化简为下面的式子<因为每个

,那么上式可以简化为(想一想为什么可以化简为下面的式子<因为每个![]() 的

的![]() 确定,就没必要让

确定,就没必要让![]() 从1到k累加计算了,只需要直接计算对应的

从1到k累加计算了,只需要直接计算对应的![]() ):

):

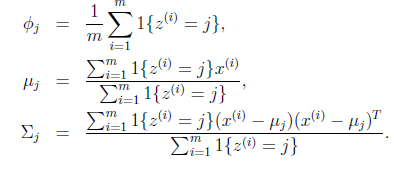

这时候我们再来对![]() 和

和![]() 进行求导得到:

进行求导得到:

![]() 是类别为j的样本(即

是类别为j的样本(即![]() )占总样本数的比率。

)占总样本数的比率。![]() 是类别为j的样本特征均值,

是类别为j的样本特征均值,![]() 是类别为j的样例的特征的协方差矩阵。

是类别为j的样例的特征的协方差矩阵。

实际上,当知道![]() 后,最大似然估计就近似于高斯判别分析模型(Gaussian discriminant analysis model)了。所不同的是GDA中类别y是伯努利分布,而这里的z是多项式分布,还有这里的每个样例都有不同的协方差矩阵,而GDA中认为只有一个。

后,最大似然估计就近似于高斯判别分析模型(Gaussian discriminant analysis model)了。所不同的是GDA中类别y是伯努利分布,而这里的z是多项式分布,还有这里的每个样例都有不同的协方差矩阵,而GDA中认为只有一个。

3)EM算法

上一节我们假设知道了![]() ,实际上

,实际上![]() 是不知道的。那么怎么办呢?考虑之前提到的EM的思想,第一步是猜测隐含类别变量z,第二步是更新其他参数,以获得最大的似然估计。用到这里就是:

是不知道的。那么怎么办呢?考虑之前提到的EM的思想,第一步是猜测隐含类别变量z,第二步是更新其他参数,以获得最大的似然估计。用到这里就是:

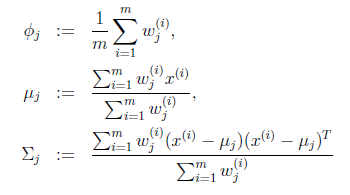

循环下面步骤,直到收敛: {

(E步)对于每一个i和j,计算

![]()

(M步),更新参数:

}

在E步中,我们将其他参数 ![]() 的具体计算公式如下:

的具体计算公式如下:  ,这个式子利用了贝叶斯公式。

,这个式子利用了贝叶斯公式。

对比K-means可以发现,这里使用了“软”指定,为每个样例分配的类别![]() 是有一定的概率的;同时计算量也变大了,每个样例i都要计算属于每一个类别j的概率。与K-means相同的是,结果仍然是局部最优解,对其他参数取不同的初始值进行多次计算不失为一种好方法。

是有一定的概率的;同时计算量也变大了,每个样例i都要计算属于每一个类别j的概率。与K-means相同的是,结果仍然是局部最优解,对其他参数取不同的初始值进行多次计算不失为一种好方法。

虽然之前再K-means中定性描述了EM的收敛性,仍然没有定量地给出,还有一般化EM的推导过程仍然没有给出。下一节着重介绍这些内容。

参考:http://www.cnblogs.com/jerrylead/archive/2011/04/06/2006924.html

- 斯坦福大学公开课 :机器学习课程(Andrew Ng)——10、无监督学习:Mixture of Gaussians and the EM Algorithm

- 斯坦福大学公开课 :机器学习课程(Andrew Ng)——11、无监督学习:the derivation of EM Algorithm

- 斯坦福大学公开课 :机器学习课程(Andrew Ng)——9、无监督学习:K-means Clustering Algorithm

- 斯坦福大学公开课 :机器学习课程(Andrew Ng)——15、无监督学习:Reinforcement Learning and Control

- 斯坦福大学公开课 :机器学习课程(Andrew Ng)——14、无监督学习:Independent Component Analysis(ICA)

- 斯坦福大学公开课 :机器学习课程(Andrew Ng)——12、无监督学习:Factor Analysis

- 斯坦福大学公开课 :机器学习课程(Andrew Ng)——13、无监督学习:Principal Component Analysis (PCA)

- 斯坦福大学公开课 :机器学习课程(Andrew Ng)——4、监督学习:Naive Bayes

- 斯坦福大学公开课 :机器学习课程(Andrew Ng)——8、监督学习:Learning Theory

- 斯坦福大学公开课 :机器学习课程(Andrew Ng)——2、监督学习:Regression and Classification

- 斯坦福大学公开课 :机器学习课程(Andrew Ng)——3、监督学习:Gaussian Discriminant Analysis (GDA)

- 斯坦福大学公开课 :机器学习课程(Andrew Ng)——5、监督学习:Support Vector Machine,引

- 斯坦福大学公开课 :机器学习课程(Andrew Ng)——6、监督学习:Support Vector Machine,破

- 斯坦福大学公开课 :机器学习课程(Andrew Ng)——7、监督学习:Support Vector Machine,立

- 斯坦福大学公开课机器学习课程(Andrew Ng)二监督学习应用 梯度下降

- 斯坦福大学公开课 :机器学习课程(Andrew Ng)——1、整体看一看

- 斯坦福大学公开课机器学习课程(Andrew Ng)第一讲机器学习动机与应用

- 斯坦福大学公开课机器学习课程(Andrew Ng)五生成学习算法

- C++中的抽象类(接口和协议)

- XShell配置Socket5代理

- 输入汉字,得到汉字的大写首字母

- UVa 455 最小重复字符串

- wpa_cli P2P 连接相关调试命令

- 斯坦福大学公开课 :机器学习课程(Andrew Ng)——10、无监督学习:Mixture of Gaussians and the EM Algorithm

- 去掉或自定义ExpandableListView的箭头图标

- linux服务器怎么修改时区和时间

- Java_语法基础_保留指定位数小数

- popToViewController、pushViewController问题

- Undefined symbols for architecture arm64 :(shareSdk weibo)

- Field 对象

- iphone NSString 字符串处理:截取字符串、匹配字符串、分隔字符串

- 验证码